En la saga de Fundación, Isaac Asimov cuenta la historia de Hari Sheldon, un científico que desarrolla una disciplina llamada psicohistoria. Se trata de una teoría estadística que permite predecir el comportamiento de las sociedades mediante modelos matemáticos. Es así que llega a la conclusión de que la humanidad se dirige inexorablemente hacia la extinción, por lo que elabora un plan para refundar la civilización en un lejano planeta llamado Fundación.

Como sucede en toda gran obra de ciencia ficción, Fundación esconde detrás de una trama sobre futuros lejanos y viajes interplanetarios una disquisición sobre los debates filosóficos más profundos que caracterizaron la época en la cual fue escrito, en este caso la primera mitad del siglo XX. ¿Puede el comportamiento humano ser capturado por leyes físicas, como las que describen la trayectoria de una manzana en caída libre o la órbita de los planetas? ¿Las ciencias sociales deberían, al alcanzar el estado de maduración adecuado, sucumbir ante el lenguaje matemático, como lo hicieron a su tiempo las ciencias naturales? ¿Qué sucede entonces con el libre albedrío? ¿Quiere decir que hay fuerzas imperceptibles a nuestros ojos que guían los acontecimientos históricos y nuestra capacidad de decidir sobre ellos no es más que una mera ilusión? Arranquemos.

¿Puede el comportamiento humano ser capturado por leyes físicas, como las que describen la trayectoria de una manzana en caída libre o la órbita de los planetas?

Ya para la época en la que Asimov escribió sus novelas, las bases de la rama de la física denominada mecánica estadística estaban sentadas y puede que el autor haya inspirado varias de sus ideas en las teorías del austriaco Ludwig Boltzmann.

Para entender el tipo de postulados de la mecánica estadística, pensemos en un gas en un recipiente cerrado. El sistema está compuesto por miles de millones de moléculas que, vistas individualmente, se mueven en trayectorias difícilmente distinguibles del azar absoluto. Más precisamente, para predecir cuál será posición de una molécula en el futuro sería necesario conocer la posición de cada una de las demás moléculas que se encuentran en el recipiente colisionando entre sí, lo cual es virtualmente imposible. Sin embargo, si vemos el gas como un todo, un continuo de materia que se mueve como un único cuerpo, su comportamiento se vuelve predecible: sabemos de manera exacta cuánto se va a comprimir si se le aplica una determinada presión, o cuánto se expandirá si aumentamos su temperatura. Boltzmann incluso llegó a derivar fórmulas que permiten conocer la distribución de velocidades de las moléculas de un sistema sin necesidad de conocer siquiera cuál es su identidad química, o sea, si se trata de un gas de oxígeno, nitrógeno o un zapato.

Entonces el resultado es impredecible a nivel de sus elementos constitutivos fundamentales (las moléculas), pero a nivel colectivo emerge un comportamiento ordenado.

En la novela de Asimov, la psicohistoria opera de una manera similar: si bien no podemos predecir el comportamiento individual de un humano, las sociedades, vistas como organismos macroscópicos compuestas por millones de personas, al igual que el gas, podría comportarse como un sistema predecible.

No fue hasta la década del ochenta que el desarrollo de la computación permitió que lo que hasta ese momento era ciencia ficción se convirtiera en un campo de investigación con nombre propio. Había nacido la física de sistemas complejos.

Esta rama de la física se propone extender la aplicación de las herramientas de la mecánica estadística hacia sistemas más generales: desde el flujo de opiniones dentro de una sociedad hasta la distribución del ingreso económico, desde el cerebro humano hasta los movimientos colectivos de las aves. Todo sistema compuesto por componentes individuales que interactúan puede devenir en objeto de estudio.

Un concepto clave en la teoría de sistemas complejos es la idea de comportamiento emergente: el sistema visto como un todo presenta comportamientos y propiedades que nada tienen que ver con las características de las unidades que lo componen. Como en el ejemplo de las moléculas de gas, el todo no es igual a la suma de las partes.

Entonces lo importante no es conocer los detalles de los elementos individuales sino más bien entender cómo se organizan e interactúan entre sí. Es por eso que los físicos propusieron modelos lo más sencillos posibles para independizarse de las características micro y concentrarse sólo en el comportamiento macro o emergente. Vamos a un ejemplo.

El átomo social

Uno de los primeros intentos por reproducir la idea de psicohistoria fue el llamado modelo de Axelrod de difusión cultural, desarrollado en 1994. Este modelo extremadamente sencillo representa a los individuos de la población como nodos interconectados en una red, cada uno de ellos caracterizado por una serie de atributos culturales (ideología, religión, opiniones, etc.) que interactúan de la siguiente manera: En cada paso de la simulación un nodo puede, de manera aleatoria, copiar un atributo de un nodo vecino y adoptarlo como propio. Cuando el sistema alcanza un estado estático, es decir, no se observan cambios de los atributos globales en el tiempo, la simulación se detiene (ver imágen).

A pesar de su simplicidad casi ofensiva, este modelo permite reproducir comportamientos sociales complejos como el surgimiento de tendencias monoculturales, multiculturales o polarizadas, de acuerdo a las condiciones en las que se realiza la simulación.

¿Hasta qué punto lo que opinamos es producto de un análisis racional de la realidad y no es meramente el resultado de un proceso de mimetización con las personas que nos rodean?

Si un modelo en donde la opinión o la cultura de un individuo se basa exclusivamente en intercambios aleatorios con sus vecinos presenta propiedades emergentes tan complejas surge una pregunta incómoda: ¿Hasta qué punto lo que opinamos es producto de un análisis racional de la realidad y no es meramente el resultado de un proceso de mimetización con las personas que nos rodean?

Después de todo, no es muy distinto a lo que plantea el politólogo Jaime Durán Barba cuando dice que la política ya no se trata de convencer con argumentos, sino de conectar a través de la emoción, la segmentación y el Big Data.

Con el pasar de los años, diversos grupos de investigación agregaron nuevos ingredientes al modelo de Axelrod, incluyendo la influencia de los medios de comunicación y las redes sociales, y hoy por hoy este tipo de análisis es estándar dentro del campo. Para seguir indagando, este y otros resultados de la llamada socio-física pueden encontrarse en el libro "El átomo social" de Mark Buchanan.

Cientificistas vs. anti-cientificistas, la guerra continúa

Yendo al plano filosófico, hay una pregunta latente detrás de los planteos de la física de los sistemas complejos: ¿Pueden las ciencias sociales estudiarse con los mismos formalismos matemáticos que la física?

La pregunta no es nueva y nos remonta al debate entre positivistas y antipositivistas que dominó gran parte del siglo XX. De manera híper simplificada podría resumirse así: por un lado, el filósofo Auguste Comte fue el primero en plantear que las sociedades no difieren en esencia de los sistemas físicos y por lo tanto su estudio debe ser tratado con lenguaje matemático.

Menos fundamentalista pero en la misma dirección, el argentino Mario Bunge postulaba el método científico como ideología, como forma de superar el debate faccioso dominado por intereses particulares. De hecho, Bunge hoy es mencionado como influencia de varios miembros de la comunidad de socio-física.

Este positivismo radical fue con el tiempo refutado por, entre otros, el físico Thomas Kuhn, quien acuñó el concepto de paradigma. Según él, el conocimiento empírico siempre está teñido por la matriz ideológica-histórica-cultural del observador, y por lo tanto no se puede aspirar a acceder a una ley universal que describa el comportamiento de las sociedades.

Un análisis más profundo sobre esta dicotomía puede encontrarse en el libro "Sistemas Complejos", de Rolando García, científico argentino reconocido por su aporte a la teoría de los sistemas complejos y la meteorología, además de por haber tenido un rol notable en la "Noche de los Lápices".

A pesar de todo, el debate sigue vigente, y basta con encender la televisión para presenciar acalorados debates sobre si la economía es una ciencia exacta o social. Viendo a los personajes que defienden una y otra postura uno se pregunta ¿Es la matemática de derecha?

Tal vez, aunque sea como mero ejercicio, sea interesante no tomar partido en este debate sólo guiados por el hecho de que, en la práctica, las voces que sostienen el pensamiento matemático provienen mayoritariamente de la derecha del espectro ideológico, usualmente como justificativo de las políticas de austeridad, mientras que del otro lado se suele criticar la frialdad de la las planillas de Excel y abogar por la importancia de que los números cierren con la gente adentro. De vuelta cabe preguntarse si estamos formando nuestra opinión por análisis racional o por afinidad ideológica.

Econofísica: La izquierda menos pensada

Un claro ejemplo de que el pensamiento matemático puede también ser de izquierda está en el propio Karl Marx. La filosofía de Marx, denominada "socialismo científico", contiene varios elementos que podrían caer bajo el paraguas del cientificismo, además de su nombre. Por ejemplo, la idea de que las sociedades siguen un camino evolutivo que las lleva a transicionar del feudalismo al capitalismo, para luego dar paso al socialismo, es inherentemente sistémico, en tanto no se basa en la ideología o voluntad de los individuos sino en propiedades emergentes que se dan en escalas de tiempo macro, de forma similar a la concepción de la física de sistemas complejos. Si bien en el siglo XIX la matematización de la economía todavía no estaba desarrollada, Marx se dedicó a estudiar álgebra y cálculo numérico durante varios años de su vida y en su obra "El Capital" sustenta algunos de sus postulados en fórmulas matemáticas. Incluso fueron publicados una serie de manuscritos matemáticos de Marx de manera póstuma.

Todo esto tal vez nos ayude a comprender por qué los físicos nucleados en el campo de la llamada econofísica, disciplina hermana de la socio-física, lejos de las esferas de financiamiento del capital que abarcan a la mayor parte de los centros de estudios de economía, de alguna forma continuaron con el estudio matemático del fenómeno de la desigualdad.

Al igual que en el modelo de Axelrod, donde cada individuo está representado por un nodo con atributos culturales, la econofísica simula a cada entidad económica como un agente que interactúa con otros mediante el intercambio de dinero.

Basado en esta idea, Victor Yakovenko, uno de los principales pensadores de la econofísica, se dedicó a estudiar la distribución del ingreso con las mismas herramientas estadísticas con las que Boltzmann dedujo la distribución de energía en las moléculas que forman un gas. Las coincidencias fueron sorprendentes: los resultados de Yakovenko concuerdan muy bien con la distribución de ingreso de las familias de Estados Unidos, para el 97% de la población (ver imagen).

La correlación no implica causalidad. Por ejemplo, que la población carcelaria provenga mayormente de sectores populares, no quiere decir que ser pobre aumente la predisposición a la delincuencia. Un error común que los algoritmos muchas veces reproducen.

A primera vista, esto podría verse como una justificación naturalista de la desigualdad. Si bien es cierto, hay una segunda parte del análisis de Yakovenko que llega a la conclusión opuesta: el 3% faltante, que no se ajusta al modelo estadístico, representa el segmento de mayor ingreso de la población. Quiere decir que la teoría falla al intentar reproducir la distribución de agentes de muy altos ingresos. En este punto Yakovenko plantea la división de la sociedad en dos clases: la clase que depende de su trabajo para recibir ingresos, que representa el 97% en la base de datos empleada, y un 3% cuyo ingreso es lo suficientemente alto como para multiplicarse sin necesidad de producir, que sigue una distribución mucho más desigual. En conclusión, los datos dicen que la distribución del ingreso es mucho más desigual que lo que plantea el modelo porque una pequeña porción de la población reproduce su capital de manera multiplicativa. Ni Bernie Sanders podría haberlo expresado mejor.

Cibercomunismo

A la hora de interpretar los resultados presentados debe hacerse una aclaración importante: tanto el modelo de Axelrod como el estudio de Yakovenko no pretenden erigirse como herramientas predictivas. Más bien la lógica detrás de estos experimentos es mostrar cómo, basándose en modelos muy sencillos, pueden obtenerse propiedades emergentes similares a las que se observan en los sistemas reales. Este es un mecanismo típico del pensamiento físico: simplificar el modelo para entender el núcleo del fenómeno estudiado. En otras palabras: si se puede reproducir el fenómeno con un modelo simple, entonces el comportamiento emergente no depende de los complejos detalles del sistema real. Está lejos de parecerse a la psicohistoria.

Sin embargo, todos estos desarrollos se produjeron previo de la revolución de la IA y el llamado ‘Machine Learning’ ¿Podrían estas tecnologías dar el salto y predecir el comportamiento futuro de sociedades enteras?

Lo primero que debemos aclarar al respecto es que detrás de estos nombres glamorosos no hay más que estadística, y la novedad principal con respecto a enfoques pasados radica en la capacidad de trabajar con bases de datos gigantescas, tanto de fenómenos sociales, culturales, económicos o de lenguaje. Esto permite a los algoritmos identificar patrones que a simple vista no serían visibles.

Si bien estas técnicas comparten con la socio-física la idea de matematizar las relaciones sociales, de alguna forma su modus operandi es, si bien complementario, opuesto: mientras la socio-física intenta partir de modelos simples para entender los mecanismos fundamentales del fenómeno de emergencia, los algoritmos computacionales van a exprimir los detalles a simple vista imperceptibles diseminados en enormes bases de datos para detectar correlaciones. Por ejemplo, un LLM va a seleccionar cada palabra que escribe en base a la frecuencia con la que cada palabra se utilizó en el pasado luego de la secuencia de palabras anteriores. Entonces si se escribe "Alicia en el país de las...", la siguiente palabra va a ser "Maravillas", porque en la base de datos de entrenamiento esa combinación es la más frecuente.

Dicho esto, en los últimos tiempos hemos visto aplicaciones sorprendentes de la IA y los algoritmos de aprendizaje automático, tanto en el campo de la resolución de problemas complejos (detección de enfermedades, genómica, automatización) como en capacidad de imitar lenguaje y razonamiento humano.

La trampa oculta bajo la alfombra es que la correlación no implica causalidad. Por ejemplo, que la población carcelaria provenga mayormente de sectores populares, no quiere decir que ser pobre aumente la predisposición a la delincuencia. Un error común que los algoritmos muchas veces reproducen.

Por otro lado, los algoritmos de IA son muy buenos para "interpolar", es decir, generar outputs (textos, imágenes) parecidos a los datos con los que fueron entrenados, pero muy malos para "extrapolar", o sea, generar nuevo contenido que se diferencie de todo lo anterior. Esto limita seriamente su capacidad de predicción.

Sumado a esto, a pesar de todas las proezas alcanzadas, la tecnología sigue sin poder resolver los problemas de la pobreza y la desigualdad. Es que después de todo, el algoritmo va a ser útil para realizar la tarea para la cual fue creado, y detrás de la mayoría de estas iniciativas se encuentran grandes empresas cuyo interés se limita al rédito económico. Difícilmente una IA que cargue con ese pecado original va a poder resolver los dilemas sociales si eso no representa un beneficio económico para la empresa.

Entonces cabe preguntarse si además de tener una posición defensiva con respecto a estas tecnologías, resaltando el peligro que representan para nuestra soberanía cognitiva, podríamos pensar en si hay otra IA posible. ¿Se puede pensar en una IA para la justicia social?

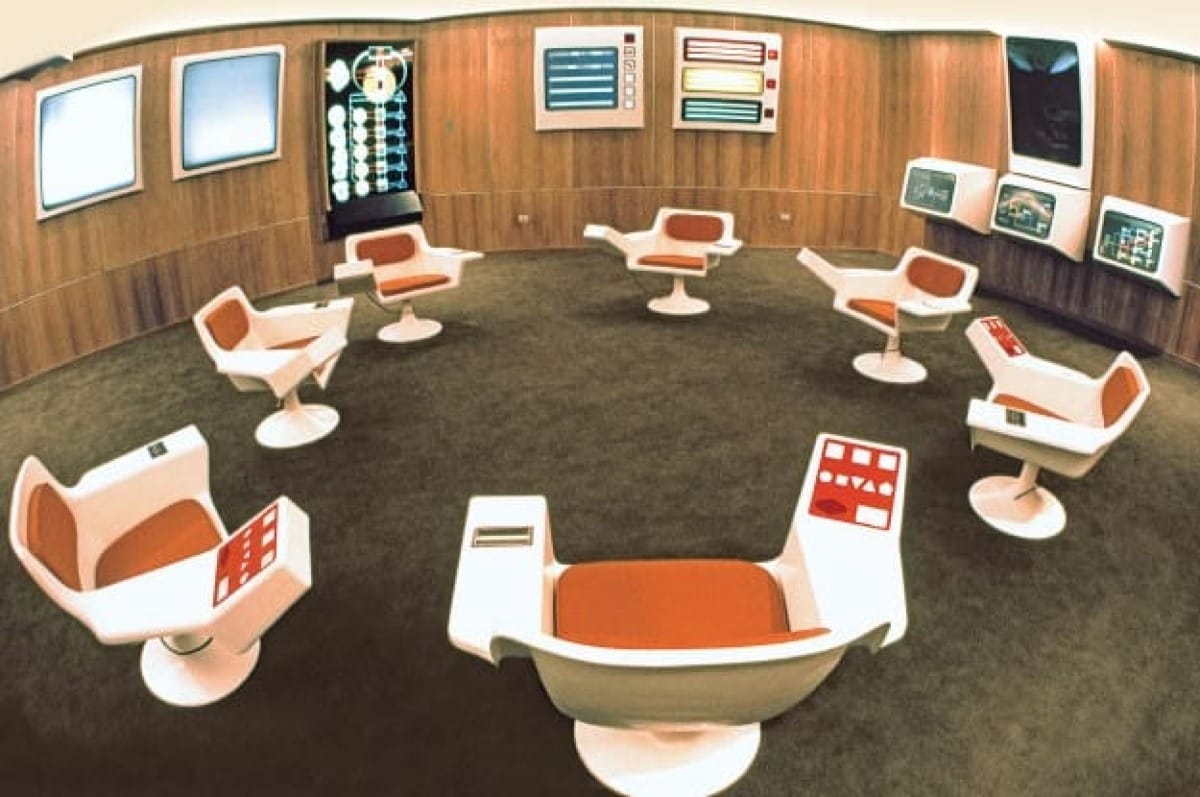

No tenemos que ir demasiado lejos para encontrar ejemplos de algoritmos diseñados para la planificación de la economía. Mucho antes de la IA, durante el gobierno de Salvador Allende en Chile, se desarrolló el proyecto Cybersyn, una sofisticada red de máquinas de teletipo que buscaba comunicar, en tiempo real, a las fábricas de todo el país con un único centro de cómputo en Santiago. Allí el gobierno procesaba y analizaba la información sobre las cadenas de valor y tomaba decisiones empleando criterios estadísticos.

Si bien los resultados de este proyecto parecían prometedores, lo cierto es que el golpe de Estado lo discontinuó y no sabemos cómo podría a haber resultado de implementarse a largo plazo.

¿Estamos dispuestos a renunciar a la democracia si un algoritmo demuestra ser un sistema de gobierno más eficiente en la organización de la economía, incluso en términos de justicia social?

Basados en este legado, y considerando las mejoras tecnológicas actuales, algunos pensadores como Paul Cockshott, un bungista declarado, comenzaron a pensar en una aplicación de la informática en la organización de una sociedad igualitaria, que denominaron Cibercomunismo. La idea básica es que si las máquinas se programaran para el fin correcto, es decir, no para maximizar ganancias si no para maximizar el bienestar del pueblo, el sueño marxista de una economía planificada se volvería posible. Tecnocracia pura y dura.

Este planteo también surge de manera interesante en el libro "La república popular de Walmart", de Leigh Phillips y Michal Rozworski. Según los autores, si la IA resultó increíblemente eficiente para organizar estructuras humanas gigantescas como las megacorporaciones de Walmart o Amazon, nada impediría extender esto al manejo de sociedades enteras.

Esta propuesta plantea un nuevo dilema: ¿estamos dispuestos a renunciar a la democracia si un algoritmo demuestra ser un sistema de gobierno más eficiente en la organización de la economía, incluso en términos de justicia social? ¿Cómo se mediría esa eficiencia, si después de todo siempre habrá intereses contrapuestos? En cualquier caso alguien debería programar esa máquina y controlar que funcionara de manera transparente, por lo que volvemos al problema de quiénes son los dueños de la IA. Si creemos que donde hay una necesidad nace un derecho, ¿no debería fomentarse un desarrollo de la IA autónomo para garantizar la soberanía? ¿Acaso es momento de pensar en Ciberperonismo?

Todas estas preguntas dejan en claro que la discusión sobre la matematización de la sociedad deja de ser abstracta y se convierte en un debate con consecuencias políticas y sociales concretas. Si bien estamos lejos de la realización de la psicohistoria, el concepto de Asimov hace tiempo dejó de pertenecer exclusivamente al terreno de la ciencia ficción y plantea desafíos de primera magnitud para los tiempos que vienen.