Galliano a raison. Dans son livre La machine ingouvernable, et dans l'intention d'appliquer une certaine rationalité à l'utilisation et la consommation d'internet, Alejandro Galliano propose que finalement l'être humain devra affronter une réalité : internet, aussi infini qu'il puisse paraître, est fini ; et ses ressources, limitées. C'est-à-dire que l'infrastructure actuelle d'internet a une limite physique, bien qu'elle ne semble pas en avoir : une certaine vitesse de connexion, un certain volume de traitement de données, une certaine largeur de bande, une certaine capacité de stockage. En fin de compte, des paramètres généraux qui composent la partie physique du réseau. Ses limites.

Rareté d'internet : la Thèse Galliano

La solution de Galliano, en accord avec sa pensée marxiste, est de limiter les usages inutiles d'internet : le rationalner, lui imposer des quotas. Bien que cette partie de l'argument ne me convainc jamais tout à fait, il y a quelque chose d'assez vrai dans l'idée d'une « rareté d'internet ». Effectivement, l'infrastructure d'internet a une limite physique, mais elle a aussi une limite économique : à quel moment une entreprise ayant besoin de ressources illimitées pour fonctionner cesse-t-elle d'être rentable ? Le symptôme que Galliano a tenté de prédire comme un possible excès de demande d'internet (données), se manifeste aujourd'hui plutôt comme un excès de demande en puissance de calcul. Voyons voir.

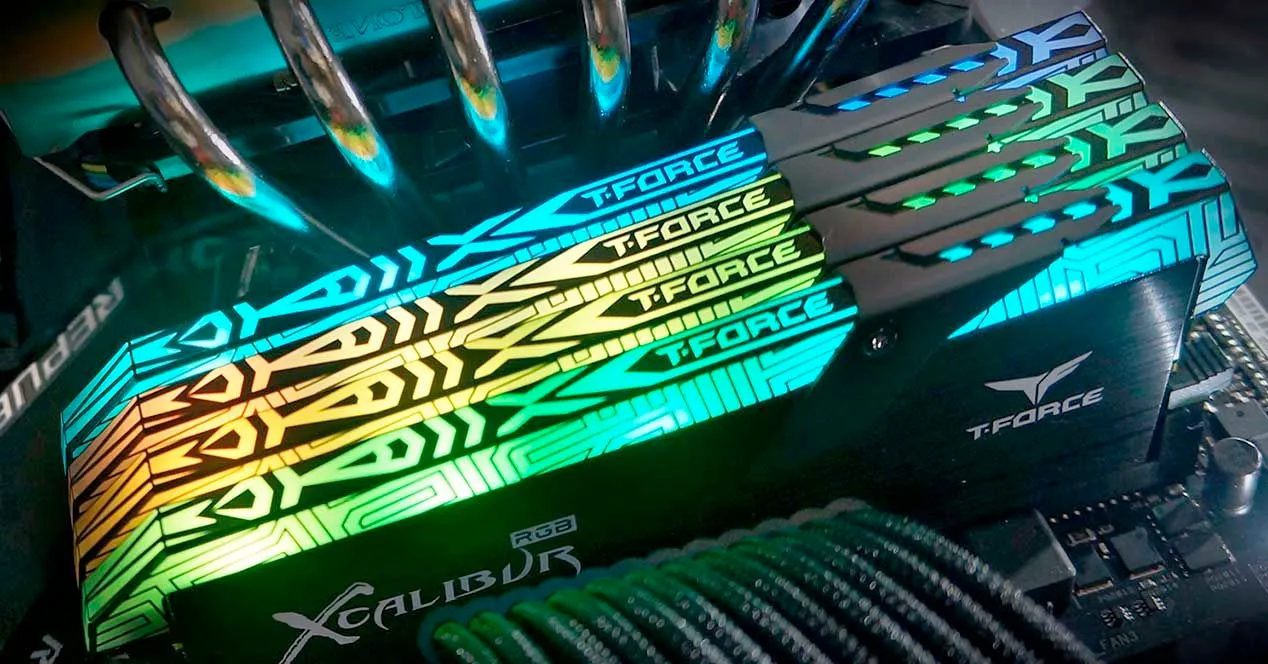

Quiconque a tenté d'acheter une carte graphique lors de la dernière frénésie de minage de Ethereum sait de quoi je parle. Pendant la dernière phase de la pandémie, le minage d'Ethereum avec des GPU ordinaires est devenu rentable pour beaucoup, ce qui a généré une bulle : les prix des GPU se sont envolés et la puissance de calcul assignée à Ethereum a augmenté exponentiellement. Quand Ethereum a abandonné le mécanisme de preuve de travail (proof of work) et a adopté la preuve de participation (proof of stake), l'extraction minière avec GPU a cessé d'être rentable et la demande s'est effondrée. Le cycle semble sur le point de se répéter : pic de demande, rareté et prix exorbitants. Mais cette fois, ce ne sont pas les cartes graphiques (GPU) mais les mémoires RAM.

Galliano l'a non seulement clarifié dans son livre, mais l'a aussi raconté dans cet épisode de Sherpas, le podcast d'El gato y la caja, et dans au moins deux des trois conférences que nous avons partagées dans l'année. Ma seule différence avec son argument est que, dans le mode de production actuel, les goulots d'étranglement provoqués par un excès de demande ne se résolvent pas par la rationalisation mais par l'augmentation des prix. Ce qui, en fin de compte, est un mode de rationalisation (de marché). Le problème, dans ce cas, est ce qui finit toujours par se passer dans le modèle capitaliste actuel : celui qui a accès à plus de ressources est celui qui va s'en approprier le plus.

RAM pour tous (ceux qui en auraient acheté avant)

La rareté de la mémoire RAM et l'augmentation soutenue des prix ne sont pas une anomalie du marché ni un accident passager de la chaîne d'approvisionnement. Ils sont la conséquence directe d'une réorganisation industrielle. L'IA, en particulier les LLM, a introduit une charge de travail qui priorise la mémoire par rapport à presque n'importe quelle autre ressource. L'entraînement et l'inférence traitent des volumes massifs de données en permanence, exigeant une bande passante extrême et une disponibilité constante. Dans ce contexte, la mémoire a cessé d'être une commodité bon marché pour devenir un intrant stratégique.

Les LLM sont des systèmes memory-bound : leur performance ne dépend pas tant du calcul pur que de la capacité à déplacer de grandes quantités de données aussi rapidement que possible. Ce détail technique est clé pour comprendre pourquoi le goulot d'étranglement ne se trouve pas dans les CPU ni même dans les GPU, mais dans la mémoire qui les alimente.

Au sein de la famille DRAM – la base de toute la mémoire moderne – coexistent différents types ayant des fonctions très différentes. DDR5 est la mémoire système classique, optimisée pour la capacité et une latence raisonnable, conçue pour les PC, les serveurs traditionnels et l'usage général. La VRAM, sous forme de GDDR, priorise la bande passante pour alimenter les GPU, sacrifiant la latence et la scalabilité de la capacité. Et puis il y a HBM, High Bandwidth Memory, qui n'est pas simplement « RAM plus rapide », mais une architecture différente : puces empilées verticalement, bus ultra larges et une intégration directe avec des accélérateurs hautes performances.

HBM est la mémoire dont l'IA moderne a besoin. Non par caprice, mais par nécessité technique. Entraîner et servir des modèles géants sans HBM est, en pratique, non viable. Le problème est que HBM et DDR5 sont en concurrence pour les mêmes usines, les mêmes processus industriels et le même capital. Quand fabriquer HBM génère des marges bien supérieures et que les clients de data center paient sans trop de limite, la décision pour les fabricants est évidente : prioriser HBM et reléguer la mémoire de consommation.

Le résultat est un effet d'expulsion. Ce n'est pas que la RAM manque parce qu'on ne peut pas la produire, c'est qu'elle a perdu sa priorité stratégique. Les PC, les consoles et le matériel domestique restent comme dommages collatéraux d'une industrie qui réorganise son offre autour de l'IA. La rareté actuelle n'est pas un bug du système, c'est un signal de saturation. Elle marque le point où une seule classe de charge de travail domine la planification industrielle et redéfinit les prix pour tous les autres. Galliano a raison.

L'impact est inévitable

Selon ce que publie Reuters, les trois principales entreprises du secteur analysent des changements dans leur production. Les géantes sud-coréennes Samsung, SK Hynix et Micron Technology réorganisent leur activité. Il est évident que, en raison du besoin de calcul et de l'injection constante de capital spéculatif dont disposent les entreprises d'IA, elles sont en position dominante sur le marché pour tordre la production en leur faveur. Si les entreprises sud-coréennes confirment cette transition pour prioriser les mémoires HBM, le marché de la RAM pour consommateurs sera un cauchemar. Les rapports d'augmentation de prix vont bon train. Les mouvements spéculatifs commencent même : les fournisseurs veulent anticiper un marché à prix élevés, achètent en masse et augmentent la rareté.

Chaque ordinateur utilisé par le public a de la mémoire RAM. Un téléphone, une console, un ordinateur portable. Nous allons-nous vers un marché avec moins de mémoire que ces dernières années ? Les prix de l'informatique pour consommateurs vont-ils s'envoler ? Voici quelques-unes des stratégies que nous avons anticipées depuis 421 pour éviter d'entrer dans ce scénario dépourvus. L'éloge que Luis Paz a fait des ordinateurs de bureau se négocie aujourd'hui 10x au-dessus de sa valeur au moment de sa publication. De même avec le concept de Soldán d'« oligarques du calcul », bien qu'à chaque fois que je le lis ça me fasse rire parce que j'imagine un gros caïd de type Kingpin entouré de mémoires et de cartes graphiques.

À ce scénario, j'ajoute deux autres questions que j'ai collectées en lisant quelques utilisateurs américains sur X. Si cette crise s'étend pendant plus d'un couple d'années, comme tout semble l'indiquer, allons-nous vers un modèle où la puissance de calcul serait concentrée dans de grands centres de données et où personne ne posséderait plus quelque chose comme un ordinateur chez soi, mais louerait ce traitement via streaming ? Et allons-nous vers un modèle de location comme celui qu'on a tenté de créer il y a quelques années avec les cloud services qui ont échoué ?

The PS3 alone had 512mb of ram in total (256MB of system RAM and 256MB of video memory) and it ran most demanding games like GTA V.

— NikTek (@NikTek) December 18, 2025

A single tab taking up to 1.2GB of RAM is some crazy unoptimized work, how can this possibly be more demanding than a fully fledged video-game?… https://t.co/3epdWWzjHZ pic.twitter.com/EQOd3zjcuO

Comme le dit le tweet cité : si une PS3 pouvait lancer un jeu du niveau de GTA V avec à peine 512 Mo de mémoire et qu'aujourd'hui un seul onglet de Google Chrome te consomme 1.2 Go, que diable s'est-il passé en matière d'optimisation ? Tant que la RAM était une mémoire relativement sans glamour et bon marché, personne ne semblait trop intéressé par l'optimisation de son utilisation. Cette tendance va-t-elle changer ? Allons-nous revenir à l'optimisation des performances de nos logiciels à partir d'une nouvelle rareté ?

Quoi qu'il en soit, il semble que 2026 apportera des ordinateurs plus chers et moins puissants pour l'utilisateur moyen. Le marché du calcul devient de plus en plus compliqué, les crises deviennent récurrentes à des intervalles plus courts, les limites physiques de la société connectée sont en vue. Galliano a raison.