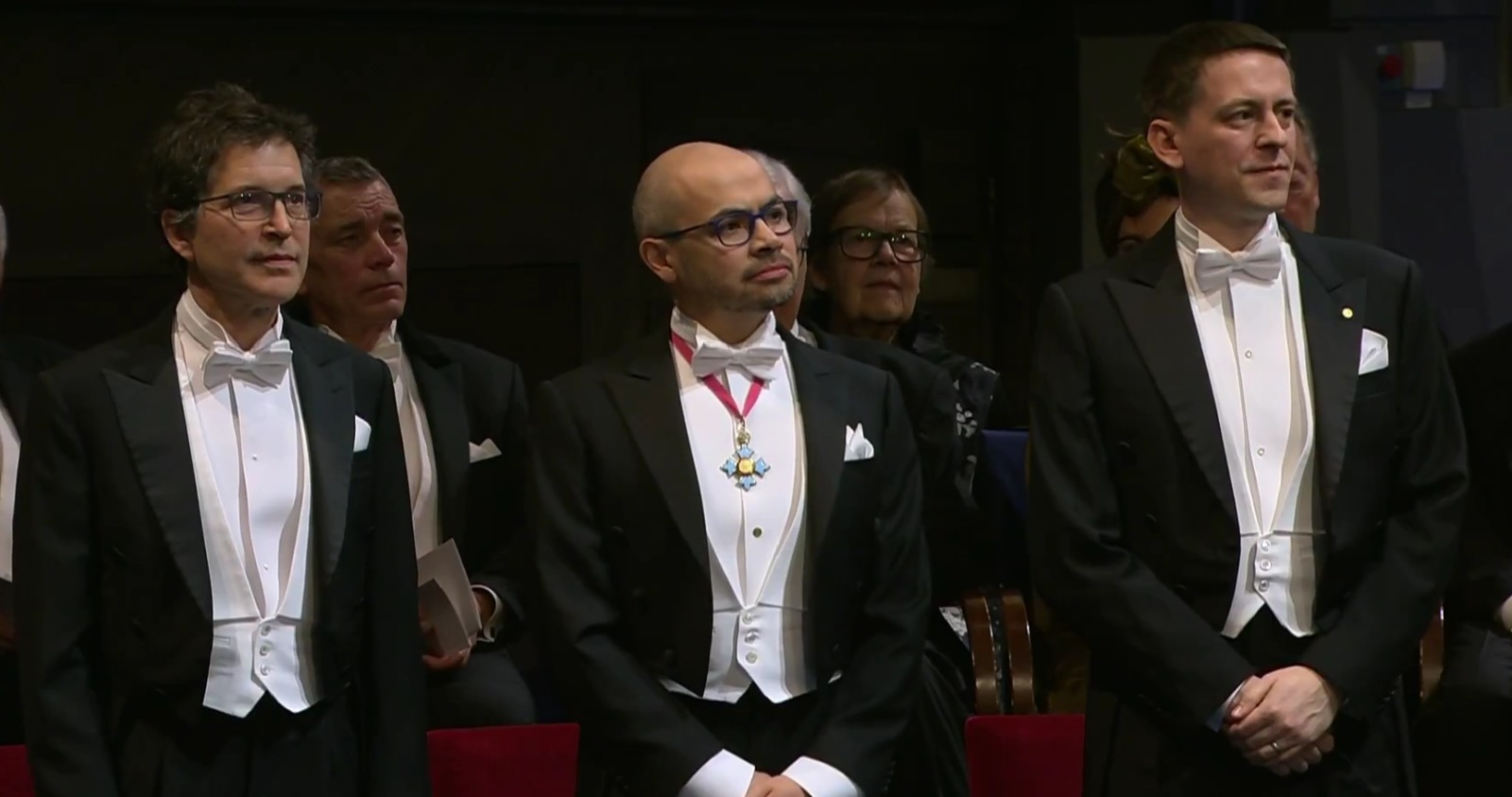

L'IA pourra-t-elle guérir les maladies ? La réponse n'est pas encore certaine, mais il ne fait aucun doute que des gens travaillent pour y parvenir. Pour y arriver, nous devons d'abord nous familiariser avec le monde des protéines et comment il a été révolutionné grâce au deep learning, au point que l'année dernière le prix Nobel de chimie a été décerné à deux groupes de scientifiques qui ont développé des modèles d'IA pour la génération de protéines. À David Baker pour la "conception informatique de protéines"; et à Demis Hassabis et John Jumper pour la "prédiction des structures de protéines".

Ce qui est également surprenant, c'est le court délai dans lequel des résultats pertinents ont été obtenus, impactant exponentiellement le domaine de la santé. Comme la plupart des modèles d'IA que nous connaissons et utilisons, tout cela a été possible grâce au développement de l'architecture Transformers (d'où vient le T dans ChatGPT) en 2017; son mécanisme de self-attention a pu être appliqué à différents domaines, comme le texte ou les images. Et trois ans plus tard, également à celui qui nous intéresse dans cette note : celui des protéines.

Pouvoir concevoir des protéines avec des fonctions spécifiques représenterait un point de rupture dans l'industrie de la santé (et dans bien d'autres) telle que nous la connaissons. Avoir la capacité de développer des anticorps synthétiques, des vaccins dans un délai plus court ou des thérapies personnalisées pour chaque patient ne sont que quelques-unes des implémentations qui peuvent commencer à se transformer en réalité.

Qu'est-ce que les protéines

On peut dire que les protéines sont la machinerie fondamentale de la vie. De manière moins poétique, ce sont des chaînes très longues d'acides aminés (AA) basées sur de petites molécules qui s'unissent entre elles. Dans la nature, il n'y en a que 20 et elles constituent une infinité de protéines; les plus petites ont environ 100 AA, mais il peut y en avoir d'autres formées par des milliers et des milliers d'AA.

Ces macromolécules, étant aussi diverses, remplissent différentes fonctions dans tout notre corps. Les plus connues sont peut-être celles qui composent les tissus musculaires (d'où le fait de parler de "consommer des protéines" en mangeant de la viande), mais il existe aussi celles qui favorisent ou accélèrent les réactions chimiques, appelées enzymes; ou les protéines de transport comme l'hémoglobine, chargée de transporter l'oxygène à travers le sang.

D'autres rôles incluent également les anticorps qui font partie du système immunitaire, les protéines de signalisation et de régulation, et celles de membrane et de reconnaissance. Dans cette dernière catégorie, pendant la pandémie, la protéine Spike, située sur la membrane du virus SARS-Cov-2 est devenue très connue (war flashbacks). La protéine Spike a une grande affinité avec le récepteur ACE2, une enzyme – oui, une autre protéine – présente sur la membrane de cellules de plusieurs organes, comme les poumons ou le cœur. Lorsque ces deux molécules s'unissent – avec d'autres processus et d'autres protéines impliquées – le virus libère son matériel génétique à l'intérieur de la cellule, causant l'infection.

Comment les protéines sont-elles étudiées

Connaître la structure d'une protéine est une pièce clé pour pouvoir comprendre sa fonction. Par exemple, pour pouvoir développer un vaccin contre le Covid (il existe différentes technologies, mais dans ce cas ce sera la "protéine recombinante"), la protéine Spike est produite in vitro isolée du reste du SARS-Cov-2. En connaissant sa structure, des modifications spécifiques sont implémentées pour la maintenir dans la même forme qu'elle a dans la membrane du virus (état de préfusion, avant de se lier au récepteur de la cellule humaine). Cette étape est importante car lors de l'administration du vaccin, le système immunitaire répond à la Spike avec des anticorps qui bloquent la liaison au récepteur ACE2. Ces anticorps se lient à la Spike, apprenant ainsi la réponse, au cas où le virus entrerait dans l'organisme.

Le problème est de savoir comment les chercheurs peuvent analyser une protéine qui a, dans ce cas, ~1200 AA et une longueur de ~15nm (c'est-à-dire, 0,000015 mm, infinitésimal). Clairement, cela a présenté un goulot d'étranglement pour le développement biotechnologique basé sur ces molécules, c'est pourquoi la mise en œuvre de modèles d'IA est venue pour révolutionner toute cette logique.

La méthode standard s'appelle cristallographie aux rayons X et nécessite d'abord d'obtenir une protéine stable et en quantités considérables. Ensuite, l'échantillon doit être purifié et modifié chimiquement pour pouvoir obtenir des cristaux (que les milliers de copies de cette protéine s'ordonnent de manière répétitive et uniforme). Cette étape est cruciale et compliquée, car toutes les protéines ne peuvent pas former des structures cristallines. L'étape suivante consiste à les exposer à des rayons X pour générer des motifs de diffraction qui révèlent comment ces particules ont interagi avec le cristal. La dernière étape devient très complexe, utilisant des transformées de Fourier, des cartes de densité électronique et des programmes de modélisation structurale. Le résultat de tout ce processus est finalement un modèle atomique détaillé de la protéine.

AlphaFold et RFdiffusion

Les deux modèles qui ont fait écho dans la communauté scientifique étaient AlphaFold (développé par Demis Hassabis et John Jumper) et RoseTTAFold/RFdiffusion (à la charge de David Baker).

En 2010, Hassabis avec Shane Legg (qui reste impliqué bien qu'il ne soit plus aussi cité) et Mustafa Suleyman (qui a quitté l'entreprise en 2019) ont fondé DeepMind, une entreprise axée sur l'intelligence artificielle générale (AGI) et l'apprentissage par renforcement (RL) dans le domaine des jeux vidéo. En 2014, Google l'a achetée pour environ 500 millions de dollars. Et des années plus tard, en 2018 sous la direction de Jumper, ils ont lancé AlphaFold1, le premier modèle à utiliser le deep learning appliqué au développement de protéines. Celui-ci appliquait les CNNs pour prédire les paramètres géométriques (distances et angles) entre paires d'acides aminés et pouvoir reconstruire la structure de la protéine.

Bien que ce soit un jalon, il présentait encore des limitations quant à la précision avec laquelle il définissait les positions des atomes. Le boom s'est produit avec AlphaFold2, qui a basé son architecture sur les mécanismes de self-attention de Transformers (ce Transformer modifié l'ont appelé Evoformer), les appliquant à la séquence d'AA, capturant les relations structurales d'AA qui peuvent être éloignées dans la séquence mais dans leur structure 3D, par les repliements, finissent par être des "voisins".

Jusqu'à ce moment-là, la structure d'environ 120 000 protéines était connue, fruit de années de recherche et de techniques standard comme la cristallographie mentionnée. Après l'apparition d'AlphaFold2, on peut accéder à plus de 200 millions de structures, chargées dans sa propre base de données AlphaFold DB, bien sûr maintenue par DeepMind.

En revanche, les études initiales de Baker remontent au début des années 2000 avec Rosetta, un programme qui sur la base de modèles physiques et énergétiques était utilisé pour prédire et concevoir des protéines in silico (c'est-à-dire virtuellement). Son approche était basée sur des algorithmes informatiques classiques, sans utiliser les outils de l'IA. Au cours de la décennie 2010, l'équipe a continué à travailler et a commencé à incorporer le machine learning classique comme les random forests ou les régressions, jusqu'à ce qu'en 2021 ils lancent RoseTTAFold, qui base son architecture sur AlphaFold2 mais avec une implémentation plus accessible sur le plan informatique, et publiée en open source.

RFDiffusion est apparu en 2023 et l'innovation est qu'il permet de saisir comme entrée que la protéine finale ait certaines fonctions. Au niveau de l'architecture, le modèle applique le processus de diffusion générative, qui consiste essentiellement à ajouter du bruit aux données d'entrée et d'entraîner le réseau pour qu'il puisse supprimer ce bruit pour, via RoseTTAFold et ses mécanismes d'attention sur les coordonnées 3D, obtenir la structure "propre" de la protéine. Ce modèle ne prédit donc pas seulement les structures mais permet de concevoir des protéines avec des fonctionnalités spécifiques. Comme son prédécesseur, RFdiffusion est également open source.

En mai de l'année dernière, AlphaFold3 a été publié, produit de DeepMind en collaboration avec Isomorphic Labs, une autre entreprise également fondée par Hassabis et qui fait également partie de Google (en réalité d'Alphabet Inc, la société mère de Google). L'essentiel de ce nouveau modèle est qu'il peut prédire l'interaction ligand-récepteur, c'est-à-dire comment deux molécules s'unissent. Par exemple, l'ibuprofène (médicament ou ligand) s'unissant à la cyclooxygénase (une protéine qui produit des molécules qui causent la douleur et l'inflammation).

Pour cela, un changement dans l'architecture du modèle a été implémenté, et en accord avec RFdiffusion, la diffusion générative a été utilisée, quelque chose de plus utile pour pouvoir prédire les différentes configurations possibles de systèmes multimolécules plus complexes. Il inclut également d'autres structures moléculaires comme l'ARN ou anticorps-antigène, bien que pour ces cas les résultats obtenus ne soient pas aussi remarquables. Ce qui est prometteur avec cet outil, c'est qu'il dépasse actuellement la technique standard, l'amarrage computationnel, pour simuler l'interaction ligand-protéine, car il peut capturer la flexibilité de la protéine lorsqu'elle est affectée par l'incorporation du ligand.

Ce qui s'en vient

Isomorphic Labs est l'une de plusieurs entreprises qui se consacrent à l'utilisation de l'IA pour concevoir des médicaments. Au début de cette année, elle a annoncé qu'elle vise à avoir un premier médicament développé sur la base d'AlphaFold3 pour la fin de 2025 et qu'elle met l'accent sur les principales maladies : neurodégénératives, cardiovasculaires et oncologiques. En avril, ils ont obtenu, lors de leur premier cycle de financement, un financement de 600 millions USD et récemment, en juillet, lors d'une interview pour Fortune, leur président, Colin Murdoch, a annoncé qu'ils sont en passe de commencer des essais cliniques chez l'homme, avec l'aide de grands laboratoires pharmaceutiques comme Eli Lilly et Novartis.

Tout cela semble très prometteur et, si cela fonctionnait, les processus de recherche et développement de médicaments qui durent normalement entre 5 et 10 ans pourraient être complètement révolutionnés, non seulement en optimisant les délais et les coûts, mais on pourrait également accéder au traitement de maladies complexes à traiter, en étant capable de concevoir des médicaments basés sur de nombreuses simulations et configurations jusqu'à obtenir celui qui agisse de manière spécifique et plus efficace.

Nous savons que l'IA est venue pour rester, et le cas des protéines est l'un des nombreux domaines dans lequel elle booste le secteur de la santé. Il existe déjà des cas où son application a optimisé le diagnostic, par exemple une détection précoce du cancer du poumon en mettant en œuvre un modèle pour analyser les tomodensitométries. En Argentine, il existe même Entelai, une entreprise fondée en 2018 qui est à l'avant-garde du diagnostic par imagerie assisté par IA dans la région.

Je ne veux pas oublier de mentionner que il est impossible de penser au progrès de l'IA sans que le développement du matériel informatique et de l'électronique l'accompagnent, c'est pourquoi l'informatique quantique (avec son optimisation de la capacité de traitement) résonne de plus en plus, avec de grandes entreprises comme Google ou Microsoft commençant à lancer des processeurs quantiques.