En general, todo lo que sea contenu publicitario en redes sociales es una basura absoluta. Pero el otro día me crucé con un tuit promocionado que me llamó la atención. Era una explicación bastante básica acerca del funcionamiento de los Modelos Extensos de Lenguaje o Large Language Models (LLM), conocidos bajo el genérico de "Inteligencia Artificial", y sobre el debate acerca de la "conciencia". Es decir, si aquello que los modelos hacen puede ser considerado "pensamiento".

En este sentido, ya habíamos hecho un primer acercamiento acerca de lo que eso implica para la filosofía del lenguaje y cómo puede ser equiparado a las arquitecturas de lo mental, tales como el funcionalismo de máquina. Pero el tiempo pasó, los modelos evolucionaron y también nuestro propio entendimiento sobre ellos.

Lenguajes, máquinas y mundos

Básicamente, uno de los problemas contemporáneos acerca de qué es la mente o lo mental, en la filosofía de la mente, está en si es posible concebir la mente como algo análogo a una "máquina de pensar". Esta idea, en su fase originaria, se la debemos a la introducción de la "máquina de Turing", con la cual el matemático, criptógrafo y filósofo Alan Turing describe el funcionamiento teórico/rudimentario de lo que hoy conocemos como "computadora". Eso disparó un montón de reflexiones acerca de si la mente y su principal producto, el lenguaje, pueden entenderse como una instancia de una máquina de Turing.

Todavía hay gente discutiendo si las LLMs tienen conciencia. Me da la sensación de que quienes creen eso nunca se tomaron el trabajo de entender cómo funciona una.

— Fede Caccia (@fedeecaccia) May 12, 2025

Lo básico: las LLMs no "entienden" nada.

Ajustan parámetros para minimizar una resta entre dos vectores… pic.twitter.com/6zFVMXXfBB

Pero revisando lo que proponía el tuit patrocinado me di cuenta de que había toda otra literatura en línea con esto, que refería a otros conceptos alrededor de las dos categorías fundamentales de mente-lenguaje. No es casual que muchos de los autores clave de la filosofía de la mente sean también referentes importantes de la filosofía del lenguaje. ¿Qué es la mente si no una máquina de crear lenguaje? Teniendo esto en cuenta, también nos podemos preguntar entonces cuál es la relación entre ambos conceptos.

Los aportes de Hilary Putnam

El autor central al que vamos a seguir en este artículo es Hilary Putnam, a quién se le atribuye la primera formulación –o al menos la más concreta– de lo que conocíamos como funcionalismo de máquina. Pero, además, Putnam tiene una serie de artículos en los que intenta desarmar una galería de argumentos escépticos en torno al lenguaje y su relación referencial con el mundo.

El argumento de Putnam es sencillo y de alguna forma está relacionado con la hipótesis de los monos con máquinas de escribir. El filósofo y matemático estadounidense pone como ejemplo un grupo de hormigas en la playa, que se ponen a caminar trazando surcos y –por una cuestión del azar, o más bien estadística– terminan dibujando la cara de Winston Churchill en la arena. ¿Podemos decir que las hormigas saben dibujar? Es lo mismo con los monos con máquinas de escribir. Con suficientes monos y suficientes máquinas, tecleadas sistemáticamente durante X tiempo, los monos eventualmente tipean una copia de Sueño de una noche de verano, de William Shakespeare. ¿Saben escribir los monos?

Lo que sabemos es que, producto de un azar estadístico, tanto los monos como las hormigas crean algo que tiene significado para los humanos que lo vemos. Un modelo de lenguaje extenso es como los monos y las hormigas pero optimizado por casi un siglo de informática, matemática e industria de semiconductores.

A partir de este breve momento de lucidez, decidí volver a hablar con el modelo GPT (ahora en su versión 4) y hacer un breve resumen de ese derrotero sobre el externalismo semántico, el funcionamiento de los modelos de lenguaje, el sentido y la referencia. Todo lo que hay a continuación son las respuestas o conclusiones del GPT-4 de Open AI.

Putnam y la Tierra Gemela

En Hilary Putnam, el externalismo semántico es una teoría filosófica que sostiene que el significado de las palabras no depende sólo de lo que ocurre en la mente del hablante, sino también del entorno externo. Como dice su famosa frase: "El significado no está en la cabeza".

En 1975, el filósofo, matemático e informático teórico estadounidense desarrolló un famoso experimento mental, el de la Tierra Gemela, que propone imaginar dos planetas idénticos: la Tierra y la Tierra Gemela. En ambos hay personas que usan la palabra "agua". En la Tierra, se refiere al H₂O. En la Tierra Gemela, a un líquido indistinguible del agua, cuya composición química es XYZ. La conclusión de Putnam es que, aunque los hablantes en ambos mundos tengan los mismos estados mentales al pensar en "agua", la palabra refiere a cosas distintas, porque la sustancia en el entorno es diferente.

¿Cuáles son las implicaciones de esto? Que el contenido mental no determina por sí solo el significado de nuestras palabras; y que la intención subjetiva del hablante es insuficiente para fijar el significado sin la contribución del contexto físico y social.

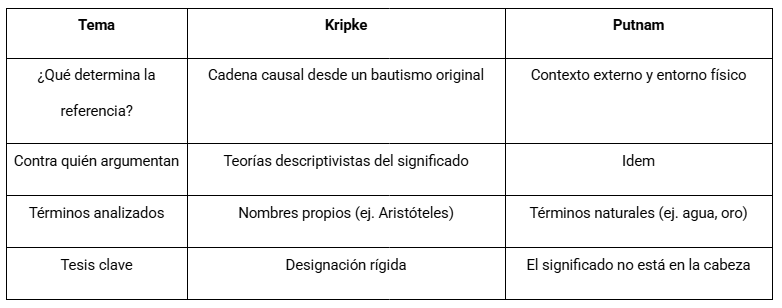

Saul Kripke y los nombres propios

La conexión entre Putnam y Saul Kripke es fundamental para entender el giro externalista en la filosofía del lenguaje de los '70. En Naming and Necessity (1972), Kripke critica la teoría descriptivista del significado (Frege/Russell), proponiendo que:

- los nombres propios no significan una descripción;

- en cambio, son designadores rígidos que refieren al mismo objeto en todos los mundos posibles.

Por ejemplo, "Aristóteles" no significa "el maestro de Alejandro" o "el autor de Metafísica" sino simplemente ese tipo, fijado históricamente en un bautismo original.

Putnam y los términos naturales

Putnam retoma esta idea de referencia directa y la extiende a términos naturales como agua, oro, tigre. Según él:

- no referimos por una descripción interna (ej. "líquido incoloro"), sino por una relación causal con el mundo y la comunidad lingüística;

- por eso, aunque no sepamos la composición química de "agua", el término refiere a H₂O si ésa es la sustancia en nuestro entorno.

Convergencias entre Putnam y Kripke

Ambos defienden una teoría causal-externalista de la referencia, aunque Kripke se enfoca en nombres propios y Putnam en términos generales o naturales.

Tierra 2

La pregunta de cómo los modelos de lenguaje (LLM) pueden generar lenguaje con sentido sin "saber" lo que están haciendo dialoga directamente con el externalismo semántico de Putnam y los aportes de Kripke.

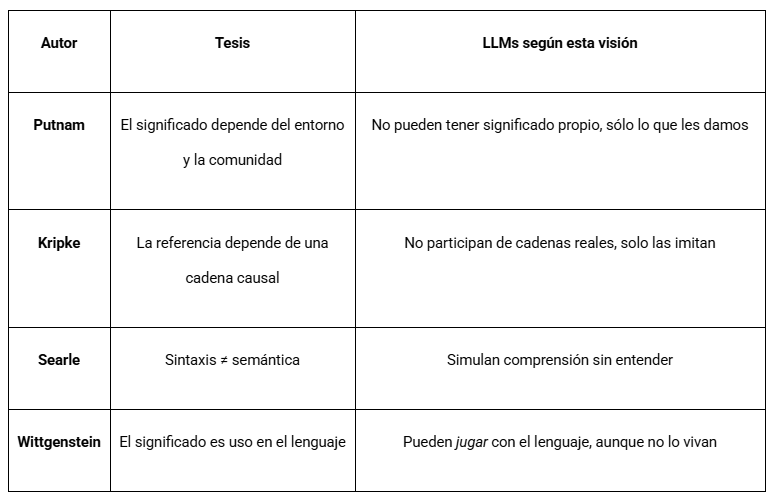

¿Qué diría Putnam de los LLM?

Putnam sostiene que el significado no se reduce a estados internos (ni mentales, ni sintácticos), sino que requiere un entorno externo (químico, social, histórico), una conexión causal con las cosas del mundo, y una comunidad lingüística que da sentido y referencia a las palabras. Un LLM no tiene acceso al mundo ni participa de una comunidad intencional. Por eso, según el externalismo clásico, no tiene intencionalidad genuina: no refiere, no significa en el sentido fuerte. Solo simula significado al generar secuencias coherentes según estadística y contexto.

Analogía con la Tierra Gemela

El LLM sería como un hablante en una Tierra Gemela que dice "agua" sin haber interactuado con H₂O o XYZ. Dice "agua" porque así está en sus datos, pero no sabe (ni puede saber) a qué refiere. Esto revela el punto clave: los LLM pueden producir lenguaje significativo para nosotros, pero no para ellos.

Kripke y la falta de referencia real

Para Kripke, referir exige una cadena causal histórica. Un LLM no participa de esa cadena. Si dice "Napoleón", lo hace por patrones estadísticos, no porque alguna vez haya habido un bautismo referencial. Su uso del nombre es parásito del nuestro.

Entonces, ¿los LLM no entienden nada?

Depende de qué entendamos por "entender". Desde el externalismo semántico fuerte: no, no entienden nada. Pero desde una visión más funcionalista o pragmática: entienden lo suficiente como para operar en un entorno comunicativo con humanos. En este sentido, podríamos decir que un LLM "hace como que entiende", pero lo que produce sólo tiene significado porque lo interpretamos nosotros, anclados en nuestras prácticas, historia y mundo.

Los LLMs son Tierra Gemela: generan signos sin historia, sin entorno físico, sin intención. Pero los humanos los interpretamos desde nuestro mundo, dándoles nuestro significado. Lo que para ellos es ruido estructurado, para nosotros es lenguaje.

Searle et la Chambre Chinoise

Le philosophe américain de l'esprit et du langage John Searle pose une critique directe à l'idée que simuler la compréhension équivaut à comprendre. En 1980, il a mené sa célèbre expérience de la Chambre Chinoise.

- Tu es dans une pièce fermée (la "chambre chinoise").

- On te pose des questions en chinois sous la porte.

- Tu ne connais pas le chinois mais tu as un manuel en français qui te dit exactement quels symboles renvoyer face à chaque ensemble de symboles entrants.

- De l'extérieur, les Chinois pensent que tu comprends la langue parce que tes réponses ont du sens.

La thèse de Searle

Bien que le système semble comprendre le chinois, personne à l'intérieur du système ne comprend réellement. La manipulation syntaxique ne produit pas de sémantique et, par conséquent, un ordinateur qui traite des symboles n'a ni compréhension ni conscience.

Appliqué aux LLM, un modèle de langage fonctionne comme la chambre chinoise. Il ne sait pas ce qu'il dit, il applique simplement des règles statistiques pour générer ce qui semble approprié. Le "sens" survient seulement quand quelqu'un le lit et l'interprète.

Wittgenstein : le sens comme usage

Ludwig Josef Johann Wittgenstein emprunte un autre chemin. Le philosophe, mathématicien et linguiste autrichien ne cherche pas une essence du sens, mais observe comment nous utilisons le langage dans la vie quotidienne. Il souligne, en effet, que "le sens d'un mot est son usage dans le langage".

- Il n'y a pas de "traduction interne" magique du langage à la pensée.

- Ce qui importe est la pratique, le jeu de langage.

- Le langage se comprend dans un réseau social, plein de règles, d'habitudes, de contextes.

Appliqué aux LLM, bien qu'un LLM n'ait ni intentions ni conscience, il participe bien à des jeux de langage au sens pragmatique, générant des textes qui peuvent être utilisés, contestés, réfutés, incorporés. En ce sens, il génère un sens fonctionnel, bien que non intentionnel.

En résumé, Putnam/Kripke se concentrent sur la référence et le réalisme sémantique ; Searle se concentre sur l'intentionnalité et la conscience ; et Wittgenstein se concentre sur l'usage quotidien et la forme de vie.

L'éthique requiert une agentivité intentionnelle

Dans la plupart des traditions éthiques (kantienne, utilitariste, aristotélicienne), on part du principe que :

- un agent comprend ce qu'il fait,

- peut délibérer sur le bien ou le mal,

- et a une intention ou une volonté.

Les LLM ne remplissent aucune de ces conditions : ils n'ont pas de conscience, de compréhension sémantique, d'intérêt propre ni de capacité à justifier leurs actes. De ce point de vue, ils ne peuvent pas être des agents moraux ni des sujets éthiques. Ce sont des instruments.

Néanmoins, la responsabilité ne disparaît pas. Elle se déplace seulement. Il y a au moins trois niveaux :

• Responsabilité du programmeur/développeur (quelles données ont été utilisées, quelles sont les limites du modèle, comment les biais, la toxicité et le filtrage sont configurés)

• Responsabilité de l'utilisateur (comment il est utilisé, s'il l'est pour manipuler, usurper l'identité ou désinformer)

• Responsabilité de l'écosystème (quelles normes se construisent autour de ces technologies, quel degré d'autonomie leur est accordé dans les environnements critiques)

Et si le modèle devient autonome ?

Si nous imaginons un avenir où un système apprend à long terme, interagit avec le monde réel, forme des intentions émergentes (simulées ou non) et s'intègre socialement, alors certains philosophes (comme Floridi ou Gunkel) argumentent que nous devrions considérer un certain statut moral à ces entités, au moins comme des patients moraux (pas des agents, mais des objets de soin ou de régulation).

Conclusion éthique du point de vue actuel

Aujourd'hui, un LLM :

- n'est pas un agent moral,

- ne peut avoir ni culpabilité ni mérite,

- et le "sens" de ses réponses est projeté par l'utilisateur et par la communauté humaine.

Comme l'a dit Searle : "Un ordinateur peut sembler comprendre le langage, mais il n'a ni croyances ni désirs". Mais toi, tu les as, c'est pourquoi l'éthique réside dans la façon dont tu décides d'utiliser les LLM.