一般的に、コンテンツがソーシャルメディアの広告である場合、それは絶対的なゴミです。しかし先日、私の注意を引いたプロモーションツイートに出会いました。それはLarge Language Models (LLM)の機能についてかなり基本的な説明で、「インテリジェンス人工知能」という一般名で知られており、「意識」についての議論についてでした。つまり、モデルが行うことが「思考」と見なされるかどうかということです。

この意味で、言語哲学にとってこれが何を意味するのか、そしてそれが機械の機能主義のような心の構造にどのように同等であるかについて、すでに最初のアプローチを行いました。しかし時間は経過し、モデルは進化し、それらについての私たち自身の理解も進化しました。

言語、機械、世界

基本的に、心の哲学における心または精神とは何かについての現代的な問題の1つは、心を「思考機械」に類似したものとして想定することが可能であるかどうかです。このアイデアは、その原始的な段階では、「チューリング機械」の導入に起因しています。数学者、暗号学者、哲学者アラン・チューリングは、今日「コンピュータ」として知られているもの理論的/初歩的な機能を説明しています。これにより、心とその主な産物である言語がチューリング機械の例として理解できるかどうかについて多くの思考が生じました。

Todavía hay gente discutiendo si las LLMs tienen conciencia. Me da la sensación de que quienes creen eso nunca se tomaron el trabajo de entender cómo funciona una.

— Fede Caccia (@fedeecaccia) May 12, 2025

Lo básico: las LLMs no "entienden" nada.

Ajustan parámetros para minimizar una resta entre dos vectores… pic.twitter.com/6zFVMXXfBB

しかし、スポンサー付きツイートが提案していたことを見直すと、心と言語という2つの基本的なカテゴリーの周りにある他の概念を参照する他の文献全体があることに気づきました。多くの心の哲学の主要な著者が言語哲学の重要な参考人物でもあるのは偶然ではありません。心が言語を作る機械でなければ何ですか?これを考慮すると、両方の概念間の関係について疑問を持つこともできます。

Hilary Putnamの貢献

この記事で追う中心的な著者はHilary Putnamであり、機械機能主義と��て知られるものの最初の定式化(または少なくとも最も具体的な定式化)に起因する人物です。しかし、Putnamには、言語とそれの世界との参照関係に関する懐疑的な議論のギャラリーを武装解除しようとする一連の論文があります。

Putnamの議論は単純で、ある意味でタイプライター付きサルの仮説に関連しています。アメリカの哲学者・数学者は、砂浜のアリの群れを例に挙げており、彼らが溝を描いて歩き、偶然の問題(またはむしろ統計)により、砂の上のウィンストン・チャーチルの顔を描き終わります。アリがどのように描くかを知っていると言うことができますか?タイプライター付きのサルも同じです。十分なサルと十分なマシンがあれば、X時間系統的にキーボードを入力した後、サルは最終的にウィリアム・シェイクスピアの「真夏の夜の夢」のコピーを入力します。サルは書くことができますか?

私たちが知っていることは、統計的偶然の産物として、サルとアリの両方が、それを見ている人間にとって意味のあるものを作ります。言語モデルは、サルとアリのようなもので、情報学、数学、半導体産業の約1世紀で最適化されています。

この簡潔な瞬間から、GPTモデル(現在バージョン4)との対話を再度開始することに決めました。外部的意味論、言語モデルの機能、意味と参照についてのこのルートの簡潔な要約を作成しました。以下のすべては、Open AIのGPT-4の応答または結論です。

PutnamとTwin Earth

Hilary Putnamの外部的意味論は、言葉の意味が話者の心の中で起こることだけに依存するのではなく、外部環境にも依存するという哲学的理論です。彼の有名な言葉の通り、「意味は頭の中にはない」。

1975年、アメリカの哲学者、数学者、理論的情報科学者は有名な思考実験「Twin Earth」を開発しました。これは2つの同一の惑星を想像するよう提案しています:地球とTwin Earth。両方に「水」という言葉を使う人がいます。地球では、H₂Oを指します。Twin Earthでは、水と区別���きない液体で、その化学組成はXYZです。Putnamの結論は、両方の世界の話者が「水」を考えるときに同じ精神状態を持っていても、言葉は異なるものを指す、なぜなら環境物質が異なるからです。

これの影響は何ですか?精神的な内容だけでは、私たちの言葉の意味を決定していない、そして話者の主観的な意図は、物理的および社会的文脈の寄与なしに意味を修正するには不十分です。

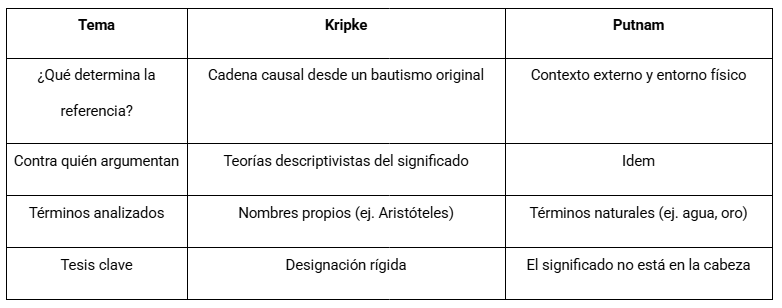

Saul Kripkeと固有名詞

PutnamとSaul Kripkeの関連性は、1970年代の言語哲学における外部主��的転回を理解するために基本的です。「Naming and Necessity」(1972年)では、Kripkeは記述主義的意味論(Frege/Russell)を批判し、次のように提案しています:

- 固有名詞は説明を意味するのではない;

- 代わりに、彼らはすべての可能な世界で同じオブジェクトを指す厳密な指定子です。

例えば、「アリストテレス」は「アレクサンダーの師」または「形而上学の著者」を意味するのではなく、単にその人で、元の洗礼で歴史的に固定されています。

Putnamと自然用語

Putnamは参照直接参照のこのアイデアを取り上げ、自然用語(水、金、虎など)に拡張します。彼によると:

- 内部説明(例:「無色液体」)によってではなく参照するのではなく、世界と言語コミュニティとの因果関係によって参照する;

- したがって、「水」の化学組成を知らなくても、それが私たちの環境の物質である場合、用語はH₂Oを指します。

PutnamとKripkeの収束

両者は因果外部主義参照理論を支持していますが、Kripkeは固有名詞に焦点を当て、Putnamは一般的または自然用語に焦点を当てています。

地球2

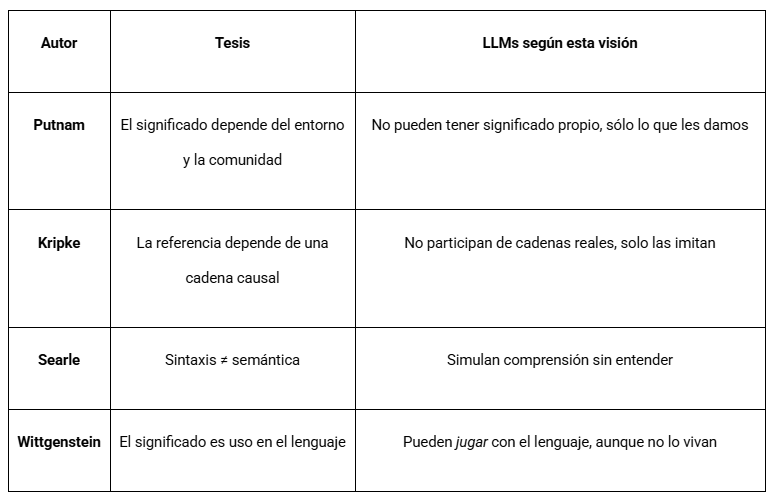

言語モデル(LLM)が「知らずに」意味のある言語を生成する方法の質問は、PutnamとKripkeの貢献の外部的意味論と直接対話しています。

PutnamはLLMについて何と言いますか?

Putnamは、意味は内部状態(精神的または構文的)だけに削減されないと主張しており、外部環境(化学、社会、歴史的)、世界の物との因果関係、および言葉に意味と参照を与える言語コミュニティが必要です。LLMは世界へのアクセスを持たず、意図的なコミュニティに参加しません。したがって、古典的外部主義によれば、真の意向性を持たない:参照しない、強い意味では意味しない。統計と文脈に従って一貫性のあるシーケンスを生成することで、意味をシミュレートするだけです。

Twin Earthとの類推

LLMは、H₂OまたはXYZと相互作用せずに「水」を言う化身のない人のようなものです。「水」と言うのは、そのデータに含まれているからですが、何を参照するか知りません(知ることもできません)。これは重要なポイントを明らかにしています:LLMは私たちにとって意味のある言語を生成できますが、彼らにとっては意味がありません。

Kripkeと実際の参照の欠如

Kripkeにとって、参照するには歴史的な因果鎖が必要です。LLMはその鎖に参加しません。「ナポレオン」と言う場合、統計パターンのためであり、元々の参照洗礼があった��らではありません。名前の使用は寄生虫です。

では、LLMは何も理解していないのですか?

「理解する」が何を意味するかに依存します。強い外部意味論から:いいえ、何も理解していません。しかし、より機能的またはプラグマティックな見方から:十分に理解して、人間とのコミュニケーション環境で動作することができます。この意味で、LLM 「理解しているふりをしている」と言うことができますが、それが生成するものは、実践、歴史と世界に固定された私たち自身が解釈する場合にのみ意味を持ちます。

LLMはTwin Earth:歴史、物理的環境、意図なしで符号を生成。しかし人間は私たちの世界から解釈し、私たちの意味を与えます。彼らにとってのノイズ構造は、私たちにとって言語です。

Searleと中国の部屋

心と言語のアメリカの哲学者John Searleは、理解を模擬することは理解することと同等であるという考え方に直接的な批判を提起しています。1980年に、彼は有名な中国の部屋の実験を行いました。

- あなたは密閉された部屋(「中国の部屋」)にいます。

- ドアの下から中国語で質問が渡されます。

- あなたは中国語を知りませんが、スペイン語のマニュアルを持っており、それは入ってくる各シンボルセットに対してどのシンボルを返すかを正確に示しています。

- 外からは、中国人があなたが言語を理解していると思います。なぜなら、あなたの答えは意味があるからです。

Searleの論文

システムが一見すると中国語を理解しているように見えても、システム内の誰も本当には理解していません。構文の操作は意味論を生み出さず、したがって記号を処理するコンピュータは理解も意識も持ちません。

LLMに適用されると、言語モデルは中国の部屋のように機能します。それが何を言っているかを知りません。適切に聞こえるものを生成するために統計的なルールを適用するだけです。「意味」はそれを読んで解釈する人がいるときにだけ発生します。

ウィトゲンシュタイン:使用としての意味

Ludwig Josef Johann Wittgensteinは別の道を歩みます。オーストリアの哲学者、数学者、言語学者は、意味の本質を探すのではなく、日常生活で言語をどのように使うかを観察しています。実際のところ、彼は「言葉の意味はそれが言語の中で使われる方法である」と強調しています。

- 言語から思考への魔法のような「内部翻訳」はありません。

- 重要なのは実践、言語ゲームです。

- 言語は社会的な絡み合いの中で理解されます。ルール、習慣、文脈に満ちています。

LLMに適用されると、LLMに意図や意識がなくても、実用的な意味で言語ゲームに参加し、使用、応答、反論、組み込むことができるテキストを生成しています。その意味で、機能的な意味を生成していますただし、意図的ではありませんが。

要約すると、Putnam/Kripkeは参照と意味論的現実主義に焦点を当てています。Searleは意図性と意識に焦点を当てています。そしてウィトゲンシュタインは日常の使用と生活形式に焦点を当てています。

倫理は意図的代理者を必要とします

ほとんどの倫理的伝統(カント的、功利主義的、アリストテレス的)では、以下のことが前提とされています:

- エージェントは自分が何をしているかを理解し、

- 善悪について熟考することができ、

- 目的または意志を持つことができます。

LLMはそのどれにも当てはまりません:意識、意味論的理解、固有の利益、または行為を正当化する能力がありません。この見方からすると、道徳的なエージェントや倫理的な主体になることはできません。それらは道具です。

ただし、責任は消えません。それは転送されます。少なくとも3つのレベルがあります:

• プログラマー/開発者の責任(どのデータが使用されたか、モデルの制限、バイアス、毒性、フィルタリングの構成方法)

• ユーザーの責任(使用方法、操作、なりすまし、または誤報に使用されているかどうか)

• エコシステムの責任(これらのテクノロジーの周りにどのような規範が構築されているか、重要な環境でそれらにどの程度の自律性が許可されているか)

モデルが自律的になったら?

長期的に学習し、現実の世界と相互作用し、出現した意図(シミュレートされているかどうかにかかわらず)を形成し、社会的に統合されるシステムの未来を想像するなら、一部の哲学者(FloridiやGunkelのような)は、少なくとも道��的な患者(エージェントではなく、ケアまたは規制の対象)として、それらのエンティティに特定の道徳的地位を考慮すべきだと主張しています。

現在の視点からの倫理的結論

現在のところ、LLMは:

- 道徳的なエージェントではなく、

- 罪悪感もメリットも持つことができず、

- その回答の「意味」はユーザーと人間のコミュニティによって予想されています。

Searleが言ったように:「コンピュータは言語を理解しているように見えるかもしれませんが、信念も欲求も持っていません。」しかし、あなたはそれを持っており、それが倫理があなたがLLMをどのように使うことを決めるところである理由です。