Galliano tem razão. Em seu livro A máquina ingovernável, e com a intenção de aplicar certa racionalidade ao uso e consumo da internet, Alejandro Galliano propõe que eventualmente o ser humano vai ter que enfrentar uma realidade: a internet, por mais infinita que pareça, é finita; e seus recursos, limitados. Ou seja, a infraestrutura atual da internet tem um limite físico, ainda que não pareça: certa velocidade de conexão, certo volume de processamento de dados, certa largura de banda, certa capacidade de armazenamento. Enfim, parâmetros gerais que fazem parte da infraestrutura física da rede. Aos seus limites.

Escassez de internet: a Tese Galliano

A solução de Galliano, em linha com seu pensamento marxista, é limitar os usos desnecessários da internet: racionalizá-la, colocar cotas. Embora essa parte do argumento nunca me convença completamente, há algo bem verdadeiro na ideia de uma "escassez de internet". De fato, a infraestrutura da internet tem um limite físico, mas ao mesmo tempo tem um limite econômico: em que ponto deixa de ser rentável uma empresa que precisa de recursos ilimitados para funcionar? O sintoma que Galliano tentou prever como um possível excesso de demanda de internet (dados), hoje se manifesta mais como um excesso de demanda de poder computacional. Vejamos.

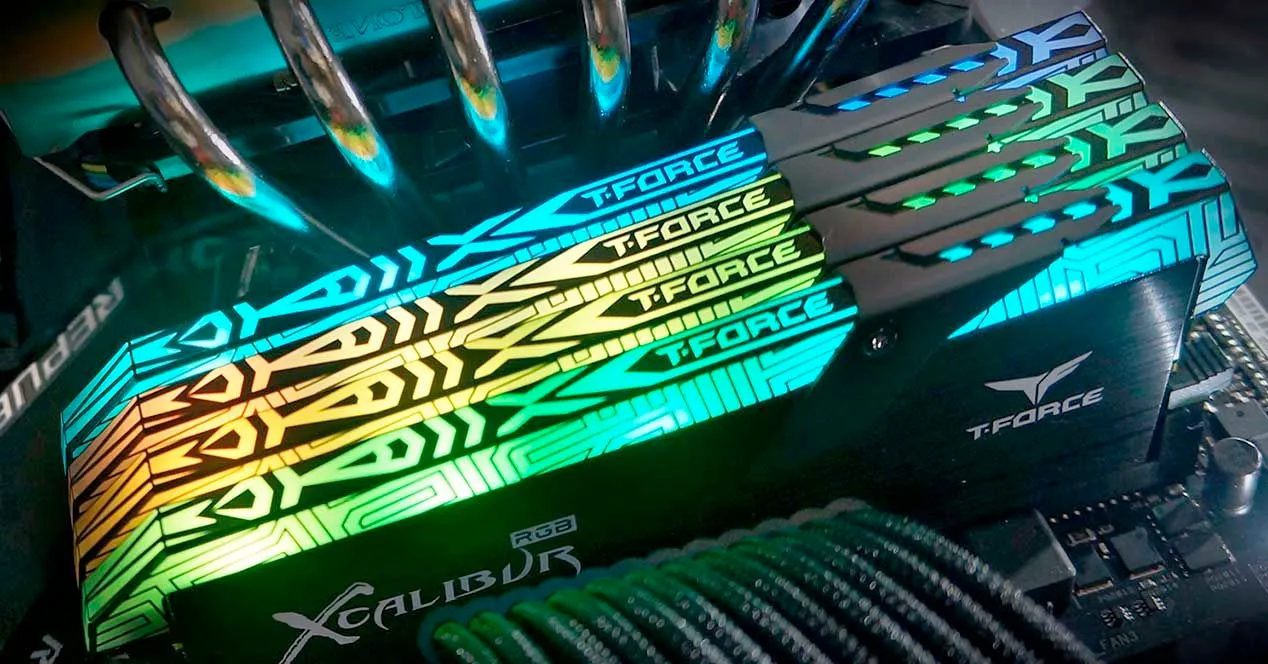

Qualquer um que tenha tentado comprar uma placa de vídeo durante a última febre de mineração de Ethereum sabe do que estou falando. Durante o último período da pandemia, a mineração de Ethereum com GPU comuns se tornou rentável para muitos, o que gerou uma bolha: os preços das GPU dispararam e a potência computacional atribuída ao Ethereum cresceu exponencialmente. Quando o Ethereum abandonou o mecanismo de prova de trabalho (proof of work) e passou para prova de participação (proof of stake), a mineração com GPU deixou de ser rentável e a demanda desabou. O ciclo parece estar prestes a se repetir: pico de demanda, escassez e preço nas alturas. Mas desta vez não são as placas de vídeo (GPU) e sim as memórias RAM.

Galliano não apenas esclareceu isso em seu livro, como também contou neste episódio de Sherpas, o podcast de El gato y la caja, e em pelo menos duas das três palestras que compartilhamos no ano. Minha única diferença com seu argumento é que, no modo de produção atual, os gargalos provocados por excesso de demanda não se solucionam via racionalização, mas por aumento de preços. Que, bem, em definitiva é uma forma de racionalização (de mercado). O problema, nesse caso, é o que sempre acaba acontecendo no modelo capitalista atual: quem tem acesso a mais recursos é quem mais vai levar.

RAM para todos (os que tiverem comprado antecipadamente)

A escassez de memória RAM e o aumento sustentado de preços não são uma anomalia do mercado nem um acidente passageiro da cadeia de suprimentos. São a consequência direta de uma reorganização industrial. A IA, em particular os LLM, introduziu uma carga de trabalho que prioriza a memória acima de quase qualquer outro recurso. Treinamento e inferência movem volumes massivos de dados de forma constante, exigindo largura de banda extrema e disponibilidade permanente. Nesse contexto, a memória deixou de ser uma commodity barata e passou a ser um insumo estratégico.

Os LLM são sistemas memory-bound: seu desempenho não depende tanto do cálculo puro quanto da capacidade de mover grandes quantidades de dados o mais rapidamente possível. Esse detalhe técnico é crucial para entender por que o gargalo não está nos CPU e nem sequer nos GPU, mas na memória que os alimenta.

Dentro da família DRAM – a base de toda memória moderna – convivem diferentes tipos com funções muito distintas. DDR5 é a memória de sistema clássica, otimizada para capacidade e latência razoável, pensada para PCs, servidores tradicionais e uso geral. A VRAM, em forma de GDDR, prioriza largura de banda para alimentar GPU, sacrificando latência e escalabilidade em capacidade. E depois está HBM, High Bandwidth Memory, que não é simplesmente "RAM mais rápida", mas uma arquitetura diferente: chips empilhados verticalmente, barramentos ultra largos e integração direta com aceleradores de alto desempenho.

HBM é a memória que a IA moderna precisa. Não por capricho, mas por requisito técnico. Treinar e servir modelos gigantes sem HBM é, na prática, inviável. O problema é que HBM e DDR5 competem pelas mesmas fábricas, os mesmos processos industriais e o mesmo capital. Quando fabricar HBM deixa margens muito superiores e os clientes de data center pagam sem muitos limites, a decisão para os fabricantes é óbvia: priorizar HBM e relegar a memória de consumo.

O resultado é um efeito de expulsão. Não falta RAM porque não se possa produzir, mas porque perdeu prioridade estratégica. PCs, consoles e hardware doméstico ficam como dano colateral de uma indústria que reorganiza sua oferta em torno da IA. A escassez atual não é um bug do sistema, é um sinal de saturação. Marca o ponto em que uma única classe de carga de trabalho domina o planejamento industrial e redefine preços para todos os demais. Galliano tem razão.

O impacto é inevitável

De acordo com o que publica Reuters, as três principais empresas do setor analisam mudanças em sua produção. Os gigantes sul-coreanos Samsung, SK Hynix e Micron Technology estão reestruturando seus negócios. É óbvio que, pela necessidade de cálculo e pela constante injeção de capital especulativo que recebem, as empresas de IA estão em uma posição dominante de mercado para torcer o rumo da produção a seu favor. Se as empresas sul-coreanas confirmarem essa transição para priorizar as memórias HBM, o mercado de memória RAM para consumidores será um inferno. Os relatos de aumentos de preços estão na ordem do dia. Até já começam os movimentos especulativos nesse sentido: os fornecedores querem se antecipar a um mercado de preços elevados, compram em massa e aumentam a escassez.

Todo computador que o público usa tem memória RAM. Um telefone, um console, um notebook. Vamos para um mercado com menos memória que nos últimos anos? Os preços da computação para consumidores vão disparar? Essas são algumas das estratégias que vimos antecipando desde 421 para evitar entrar nesse cenário desprevenido. O elogio que Luis Paz fez aos computadores de mesa hoje cota 10x acima do valor que tinha no momento de sua publicação. O mesmo com o conceito de Soldán de "oligarcas da computação", apesar de que toda vez que leio me faz graça porque imagino um cara gordo tipo mafioso Kingpin cercado de memórias e placas de vídeo.

A este cenário somo mais duas perguntas que coletei ao ler alguns usuários americanos no X. Se essa crise se estender por mais de um par de anos, como tudo parece indicar, vamos para um modelo onde o poder computacional está concentrado em grandes data centers e ninguém mais possui algo parecido com um computador em sua casa, mas aluga esse processamento via streaming? E vamos para um modelo de aluguel como o que se tentou criar alguns anos atrás com os fracassados cloud services?

The PS3 alone had 512mb of ram in total (256MB of system RAM and 256MB of video memory) and it ran most demanding games like GTA V.

— NikTek (@NikTek) December 18, 2025

A single tab taking up to 1.2GB of RAM is some crazy unoptimized work, how can this possibly be more demanding than a fully fledged video-game?… https://t.co/3epdWWzjHZ pic.twitter.com/EQOd3zjcuO

Como diz o tweet citado: se um PS3 podia rodar um jogo do nível do GTA V com apenas 512 MB de memória e agora uma aba do Google Chrome consome 1.2 GB, o que caramba aconteceu com a otimização? Enquanto a RAM era uma memória relativamente sem glamour e barata, ninguém pareceu muito interessado em otimizar seu uso. Essa tendência vai mudar? Voltaremos a otimizar o desempenho do nosso software a partir de uma nova escassez?

De qualquer forma, parece que vem aí um 2026 com computadores mais caros e menos potentes para o usuário médio. O mercado da computação está cada vez mais complicado, as crises se tornam recorrentes em períodos mais curtos, os limites físicos da sociedade conectada estão à vista. Galliano tem razão.