¿Alguna vez te pusiste a pensar en qué es una computadora? No me refiero al conjunto de componentes de Hardware que forman lo que cotidianamente llamamos PC. Apunto al concepto mismo de computación como capacidad de procesamiento de un input para producir un output siguiendo un conjunto de instrucciones programables. Pregunto por las características que debería cumplir una máquina para ser considerada computador.

Seguramente, al intentar aproximarnos a una definición, rápidamente aparezca la palabra electrónica o más precisamente la idea de circuitos eléctricos transmitiendo información, pero ¿podrían existir computadoras hechas de algo radicalmente distinto?

En esta nota propongo que nos adentremos en el universo de las computadoras no-electrónicas: desde maquetas de Lego y secuencias de chorritos de agua hasta el uso neuronas reales para reproducir de manera más eficiente algoritmos de inteligencia artificial y ¿por qué no? jugar al Doom.

All you need is compuertas lógicas

La primera pregunta que surge es: ¿por qué la electrónica es tan especial?

Siendo químico, la primera vez que escuché hablar de Silicon Valley me imaginé un gran valle con abundante presencia de minerales de silicio. En términos menos nerds: un lugar con mucha arena. Resulta que aunque sí hay playas en Silicon Valley, la apelación al silicio tiene orígenes muy distintos: este elemento es el principal insumo del componente tecnológico fundamental de la era informática: el transistor.

Estos pequeños adminículos de tres patas revolucionaron la electrónica abriendo la posibilidad de incluir operaciones lógicas dentro de los circuitos eléctricos, llamados compuertas lógicas.

Al intentar aproximarnos a una definición, rápidamente aparezca la palabra electrónica o más precisamente la idea de circuitos eléctricos transmitiendo información, pero ¿podrían existir computadoras hechas de algo radicalmente distinto?

Si bien sus antepasados directos, las válvulas de vacío, ya cumplían exactamente la misma función y fueron parte de las primeras computadoras, el transistor permitió un control más preciso y la miniaturización de circuitos que antes ocupaban salas enteras.

El transistor (técnicamente la compuerta en un conjunto de transistores, pero sigamos) va a tomar dos corrientes de entrada (inputs) y, de acuerdo a su función, va a producir una corriente de salida (output).

En una computadora, las corrientes de entrada y de salida son del tipo ON/OFF, corriente o no corriente, es decir, información binaria: ceros y unos.

La mejor forma de entender la idea de compuertas lógicas es mediante ejemplos. Veamos los más intuitivos:

Una compuerta lógica AND va a producir 1 únicamente si sus dos inputs son 1.

Una compuerta OR va a producir 1 si alguno de sus dos inputs es 1.

Muy lindo, pero hasta ahora nada de esto suena muy espectacular.

Lo interesante es que está demostrado que cualquier algoritmo, desde la suma de dos números en una calculadora hasta ChatGPT, puede ser descompuesto en una serie de operaciones lógicas fundamentales como estas. Entonces, cualquier otro artefacto capaz de recrear compuertas lógicas podría ser una computadora en potencia.

En este ejemplo (arriba), un intrépido con posibles problemas de socialización diseñó compuertas lógicas AND, OR y NOT usando bloques de Lego. En este otro (abajo), un artilugio que opera sobre chorritos de agua permite recrear compuertas lógicas en circuitos líquidos.

El único motivo por el cual estas obras maestras de la ingeniería no pueden combinarse para formar computadoras propiamente dichas es la imposibilidad de su fabricación masiva y miniaturizada, pero la base está. Es que los transistores pueden ser creados a escalas ridículamente bajas. En este video se compara el tamaño de un transistor con el de distintos objetos: ¡Los transistores actuales son más pequeños que las células! Sacá del medio loquito de los Legos.

La ley de Moore

Si los transistores son tan buenos, ¿por qué alguien querría reemplazarlos?

Según la Ley de Moore, por cierto empírica y sin fundamento teórico alguno, la cantidad de transistores que pueden entrar en un microprocesador se duplica cada dos años. Para que esto sea posible es necesario que los transistores sean cada vez más pequeños, pero se está llegando a un límite.

La ley de Moore se cumplió hasta mediados de la década de 2010, cuando empezaron a aparecer problemas para seguir reduciendo los tamaños de los transistores.

Como mencionamos en un artículo anterior, a medida que nos acercamos a la escala atómica las leyes físicas como las conocemos cambian radicalmente y entramos en el reino de la física cuántica. El comportamiento de los materiales en esta escala pasa a ser probabilístico: las corrientes eléctricas podrían teletransportarse espontáneamente de un transistor a otro, lo que se conoce como efecto túnel, perdiéndose toda posibilidad de control sobre la electrónica.

Los avances en inteligencia artificial requieren de grandes centros de cómputo que generan muchísimo calor. Se estima que los centros de datos del mundo consumen hoy por hoy más energía eléctrica que países desarrollados enteros, y el panorama a futuro pinta aún peor.

Por otro lado, la cantidad de calor que emite cada transistor hace que cualquier diseño más compacto conlleve el riesgo de levantar temperaturas incontrolables.

Este punto es particularmente importante, dado que los avances en inteligencia artificial requieren de grandes centros de cómputo que generan muchísimo calor. Se estima que los centros de datos del mundo consumen hoy por hoy más energía eléctrica que países desarrollados enteros, y el panorama a futuro pinta aún peor.

Es por esto que se comenzó a pensar en alternativas de cómputo más eficientes, no basadas en transistores. Un ejemplo de esto es la computación cuántica, en la cual las operaciones lógicas están hechas por Q-bits que pueden ser desde átomos, materiales semiconductores o hasta luz. Como ya abarcamos ese tópico, quiero mencionar otros tipos de computación menos trambólicos pero no por eso menos interesantes.

Computación óptica

Para entender la importancia de la computación óptica, lo primero que hay que remarcar es que detrás de todo el humo de la IA lo único que hay son cuentas, sumas y multiplicaciones, multiplicaciones y sumas. En particular, la gran mayoría del costo computacional (y energético) de los algoritmos de redes neuronales en los que se basa la IA se consume en multiplicar matrices.

Es por eso que se produjo un desarrollo explosivo de la computación en GPU, es decir, en placas de video, dado que poseen una arquitectura especialmente eficiente para estos cálculos. Mala noticia para los gamers, que vieron como los precios de las placas gráficas experimentaron subas astronómicas en los últimos años.

¿Cómo la luz puede ayudar en este problema?

Si bien es posible concebir la computación con luz a nivel de compuertas lógicas, como vimos en la primera parte, en este enfoque los esfuerzos se concentran en delegar a la luz únicamente la parte más costosa del cálculo: la multiplicación de matrices.

La idea es la siguiente: en lugar de que la computadora realice directamente la multiplicación, se diseña un sistema óptico cuyo propio comportamiento físico codifica el resultado. De esta manera, basta con medir la intensidad de un patrón lumínico para obtener el valor de la operación. Lo interesante de este enfoque es que permite pasar de un problema que, en una computadora tradicional, escala como N3, a uno cuya complejidad efectiva escala como N2, donde N es el tamaño de la matriz. Esto se traduce en un ahorro abismal de tiempo computacional cuando N es muy grande.

Computación biológica

Aunque la computación con átomos o con luz ya sonaba a ciencia ficción, todavía no llegamos al segmento más delirante de todos: computación con neuronas reales.

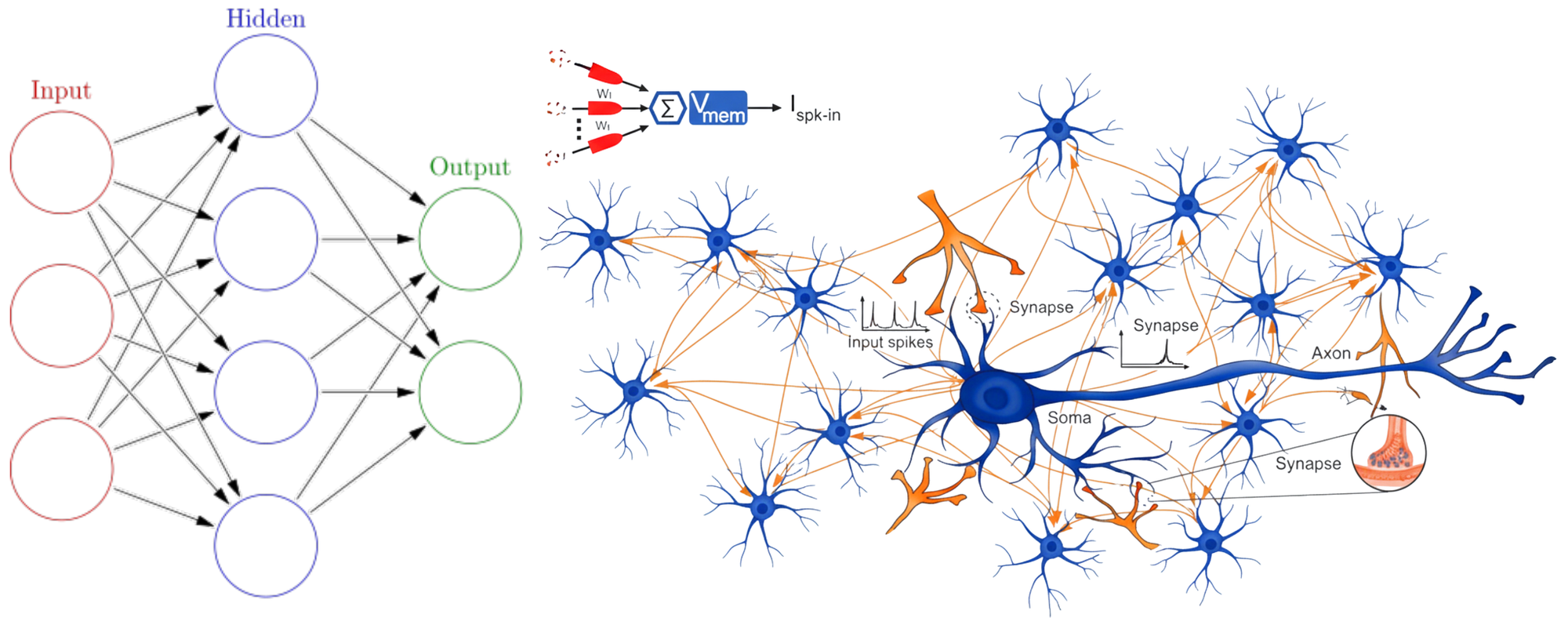

Si los algoritmos de inteligencia artificial están basados en redes neuronales, que a su vez se inspiran en las conexiones entre neuronas que hay en el cerebro, no es descabellado pensar en arquitecturas de cómputo diseñadas específicamente para estas tareas. Esto se conoce como computación neuromórfica.

Los esquemas más comunes se basan en componentes artificiales que imitan el comportamiento de las neuronas: se conectan a través de enlaces electrónicos y se disparan si reciben una señal de entrada que supere un cierto umbral. Sin embargo, los últimos avances utilizan directamente neuronas reales para alimentar los algoritmos de IA.

Más allá de la curiosidad, hay una razón muy concreta para pensar en sistemas de cómputo biológicos: la eficiencia energética de los organismos vivos supera por mucho a cualquier computadora. Así como existe el software y el hardware, los elementos biológicos que se encargan de una parte de un cálculo computacional se denominan wetware o hardware biomimético.

Hay una razón muy concreta para pensar en sistemas de cómputo biológicos: la eficiencia energética de los organismos vivos supera por mucho a cualquier computadora.

En Cortical Labs, los investigadores crearon un cyborg que combina un chip electrónico (la parte clásica de la computadora), con un tejido de neuronas que pueden "adaptarse" para cumplir una determinada función. Entonces el sistema es expuesto a una tarea, por ejemplo jugar a un juego, y tiene una recompensa positiva por cada intento exitoso. En este proceso el tejido se auto-organiza de manera tal de maximizar la recompensa: un análogo viviente al entrenamiento de una red neuronal.

Can it run Doom?

En el proyecto original, el chip Frankenstein fue diseñado para jugar al pong, pero a pesar de que el invento es de otro planeta, si realmente querían llegar a impresionar a la opinión pública debían ir por más.

El Doom es un juego de 1993 que cosechó fanáticos a lo largo de varias generaciones de gamers. Luego de su éxito inicial, se convirtió en un juego de culto famoso por su capacidad de ser instalado en prácticamente cualquier dispositivo electrónico. De ahí nace el proyecto Can it run doom. Desde calculadoras hasta tests de embarazo, freaks del mundo entero abocaron cantidades estúpidas de tiempo en ejecutar el juego en los artefactos más inverosímiles. Más allá de la definición formal de computadora, está claro que todo artefacto que se digne de considerarse como tal debe ser al menos capaz de ejecutar el Doom. Si el cyborg de Cortical Labs quería entrar de lleno al mundo Geek debía pasar la prueba máxima… y lo logró.

La magnitud del mérito en este caso es doble, porque el Doom no solo está instalado en esta computadora, si no que las neuronas aprendieron a jugarlo por sí mismas y andan por el ciberespacio aniquilando bichos intergalácticos. A buscarla al ángulo.

Una mosca atrapada en una realidad virtual

Para finalizar este recorrido por los últimos avances en materia de integración biológico-computador, un caso que opera en sentido inverso.

El chip neuromórfico que juega al Doom usa neuronas reales para aumentar la eficiencia de un algoritmo computacional. ¿Podría entonces existir una computadora que emule el cerebro de un ser vivo por completo?

Recientemente, científicos de la empresa Eon Systems mapearon el cerebro completo de una mosca en un simulador de conexiones neuronales y el resultado fue notable. La computadora creó un entorno virtual que emulaba un terreno por donde la mosca podía moverse y buscar comida. El resultado fue que la mosca virtual se comportaba exactamente como una mosca real dentro de esta realidad simulada.

Este experimento demuestra que es posible trasladar toda la información almacenada en el cerebro y trasladarla a una realidad virtual. Black mirror se quedó corto.

Por supuesto que el cerebro de una mosca es infinitamente menos complejo que el de un humano, pero la base para avanzar en el desarrollo de interfaces biológicas-virtuales ya está sentada. Tanto desde el lado de la incorporación de tejidos vivos en circuitos electrónicos para aumentar su eficiencia como desde el mapeo de cerebros enteros en un software, la integración célula-máquina está avanzando a pasos agigantados. ¿Estás listo para entrar en la Matrix?

Te gustó lo que leíste? Los Wizards hacen que 421 siga existiendo. Sumate y accedé a la revista digital, contenido exclusivo y más.