El futuro pareciera haber llegado hace unos años y todos lo estamos corriendo por atrás. Por eso, voy a poner el foco en un lugar específico: Anthropic, una empresa de la que vienen hablando todos, por lo menos desde el lanzamiento de su nuevo modelo de lenguaje este año. No voy a hablar de lo eficiente de sus modelos ni de sus valores en la bolsa, sino de algo quizás más inútil, que no sirve ni para aprender a vibecodear ni a invertir correctamente en acciones de empresas. Voy a intentar profundizar en otro debate: la ética de la IA.

Lo interesante de los modelos de lenguaje es su capacidad de realizar tareas cognitivas complejas con cierto éxito. Esto pregnó en el sentido común y llevó la discusión hacia dos posiciones extremadamente opuestas: el tecnopotimismo y la tecnofobia o tecnofilia. Producto del desamparo social, de repente una máquina, por ejemplo, podía oficiar de psicólogo. Algunos lo vieron con buenos ojos y otros no, en especial, en este caso, los psicólogos.

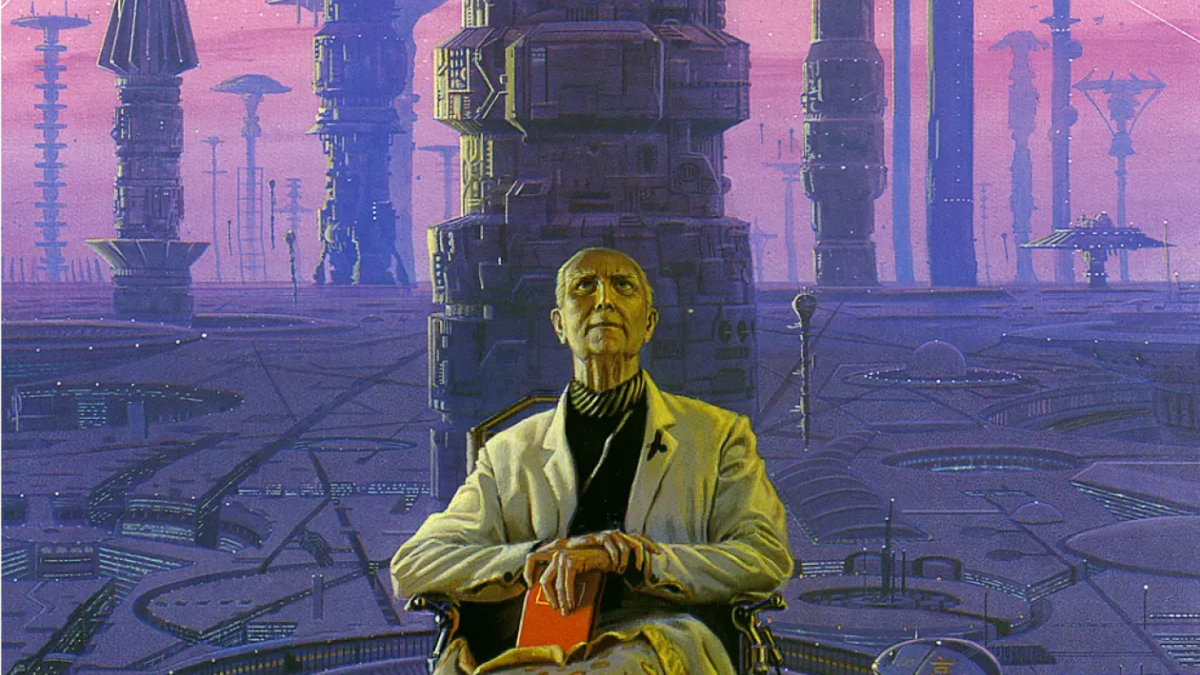

Tenemos ante nosotros, por primera vez en la historia, una inteligencia no humana, algo capaz de producir sin tener la agencia para hacerlo, algo que piensa pero no tiene cerebro biológico, algo que dice y hace pero no lo decide por su cuenta. Algo así como un superesclavo virtual.

Muchos se dieron cuenta de que la IA no era un psicólogo (ni un médico ni un plomero), pero que sí podía hacer un montón de otras cosas. Básicamente, crear aplicaciones web desde cero, crear una identidad de marca, diseñar, producir fotos y videos, etc. Tenemos ante nosotros, por primera vez en la historia, una inteligencia no humana, algo capaz de producir sin tener la agencia para hacerlo, algo que piensa pero que no tiene cerebro biológico, algo que dice y hace pero no lo decide por su cuenta. Algo así como un superesclavo virtual (pasaron los griegos y dijeron que era mucho). ¿Qué hacemos con este conflicto moral (si es que queremos hacer algo)?

¿Qué es Anthropic?

Para lo que nos toca, basta con decir que es una empresa de IA destinada a la creación e investigación de modelos. No hace falta meternos en detalles técnicos de lo que es un modelo, ni de cómo funciona. Sí cabe mencionar que es la empresa que hace funcionar a Claude Opus 4.7, modelo que quizás mucho de ustedes ya hayan utilizado y que a partir de ahora lo mencionaremos con su pseudónimo argentinizado: Claudio.

¿Por qué justo Anthropic y no otra empresa?

Bueno, ellos mismos pueden responder a esta pregunta:

Creemos que la IA podría ser una de las tecnologías más transformadoras y potencialmente peligrosas de la historia de la humanidad, y, sin embargo, nosotros mismos estamos desarrollando esta tecnología. No creemos que esto sea una contradicción; más bien, es una apuesta calculada por nuestra parte: si la IA poderosa va a llegar de todos modos, Anthropic cree que es mejor tener laboratorios centrados en la seguridad en la vanguardia, en lugar de ceder ese terreno a desarrolladores menos centrados en la seguridad.

Entonces, esta empresa cree que la Inteligencia Artificial puede ser una de las tecnologías más peligrosas de la historia de la humanidad y por eso la están fabricando ellos mismos. Eso es lo particular de toda esta escena, apostar a crear armas potencialmente peligrosas para la humanidad, pero que siempre sea en potencia y no en acto. Algo latente.

¿Qué hacen para lograr eso?

Bueno, acá ya es un poquito más complejo, pero podemos identificar a tres actores principales:

El CEO de la empresa, Darío Amodei.

La empresa (y sus publicaciones abiertas al público).

Y un tercer actor secreto que revelaré más tarde con bombos y platillos.

Vamos por el primero. Darío Amodei es conocido porque se fue de OpenIA (encargada de ChatGPT) porque la empresa no se tomaba en serio los riesgos de la IA. A priori, el subtitulado es: "Yo Darío Amodei soy demasiado bueno para estar en esta empresa del mal". Lo cual es interesante teniendo en cuenta el tipo de pensamiento derechoso y transhumanista que manejan los CEOs de las principales empresas de IA del mundo. Preocupado respecto de la IA, Amodei escribe ensayos en su blog, cuyos highlights son: Machines of Loving Grace y The Adolescence of Technology.

El primero fue escrito en octubre de 2024, hace muy poco tiempo, pero en términos de avance tecnológico pareciera que pasaron miles de años: todavía la IA no programaba a altos niveles y no podía hacer uso de tu computadora para cosas que no te dan ganas de hacer por cuenta propia. En el ensayo, Darío define que la IA avanza a ritmos increíbles y que puede ser un riesgo realmente importante. Pero inmediatamente pasa a detallar todo lo positivo que podría generar la IA en caso de que todo salga más o menos bien. No quiero detenerme mucho en ello, pero básicamente proyecta un futuro en el cual las siguientes disciplinas avanzan de forma revolucionaria: biología y salud, neurociencia y mente, desarrollo económico y pobreza, paz y gobierno, trabajo y significado. Casi una utopía en donde por fin la ciencia y la tecnología llegarán a cumplir los sueños húmedos de Kant y toda la Ilustración. Y, para el que no entendió la referencia filosófica, tienen el capítulo 6 de la primera temporada de la serie Love Death and Robot en el cual un ente súper inteligente gobierna la humanidad e ilustra mucho de lo que dice Amodei.

El segundo ensayo describe el paso inicial para lograr ese mundo tan soñado, pero antes enumera los riesgos a enfrentar: uso de la IA con fines destructivos, abuso para la toma de poder, perturbación económica y también algunos efectos indirectos como los posibles cambios laborales.

Pero tranquilos, Darío ya pensó cómo mitigar cada uno de estos problemas. Para eso, propone cuatro grandes ejes:

- IA constitucional e interpretabilidad: Entrenar a los modelos de IA bajo una “Constitución” con valores éticos que forme su identidad y carácter, complementado con técnicas de interpretabilidad mecanística para “mirar dentro” del modelo y detectar intenciones ocultas o engaños.

- Transparencia y legislación: Apoyar leyes que exijan transparencia a las grandes empresas de IA, permitiendo a la sociedad medir y mitigar los riesgos de forma quirúrgica sin sofocar la innovación.

- Contención geopolítica: Restringir la venta de chips y herramientas de fabricación a regímenes autocráticos para dar a las democracias una ventaja temporal que les permita desarrollar la tecnología de forma segura.

- Medidas económicas: Implementar impuestos progresivos robustos y fomentar la filantropía privada para redistribuir la riqueza generada por la IA y apoyar a los trabajadores desplazados.

Veamos si algunas de estas propuestas condice con lo hecho y publicado por Anthropic. Lo que nos lleva a analizar al segundo actor: la empresa.

Lo interesante es que, si uno ingresa a la web de Anthropic, logra ver que publican mucho (sobre todo, cuando realizan un avance significativo), sobre las posibles consecuencias ético-políticas de su tecnología. Los invito a indagar y revisar todo. Sino sigan leyendo, que acá ofrezco un buen resumen de las cuestiones más relevantes.

Lo primero a destacar es que tienen una Constitución de su modelo de lenguaje, la Claude’s Constitution. Afín a nuestra tradición latinoamericana, voy a nombrarla como la Constitución de Claudio. ¿Qué dice? Bueno, es un PDF de 84 páginas (de hecho, es común la gran cantidad de páginas en cada una de sus publicaciones) con tres puntos principales en lo que respecta a la ética y la acción del modelo.

El primero y más general: la misión central es garantizar una transición segura hacia una IA transformadora. Anthropic se define como un laboratorio enfocado en la seguridad que desarrolla tecnología de punta para evitar que actores menos responsables dominen el campo.

El segundo se relaciona con reglas (no muy rígidas) para sus modelos, del tipo “cultivar el buen juicio y los valores éticos”, en lugar de imponer reglas rígidas.

El tercer punto establece una Jerarquía de Valores Fundamentales que, en caso de conflicto, Claudio debe respetar y priorizar en este orden: no socavar los mecanismos humanos de supervisión; tener valores personales sólidos, ser honesto y evitar daños; seguir las reglas específicas de la empresa; beneficiar a los operadores y usuarios.

Ahora bien, hay una última cuestión bastante interesante en este documento y que nos dará pie para complejizar la discusión.

Tanto Dario Amodei como la Constitución de Claudio establecen que la tecnología IA llegó para quedarse y que puede ser potencialmente peligrosa para la humanidad, y, en consecuencia, establecen métodos de control para mitigar riesgos, que implican comprender a la IA. En este sentido, Anthropic se pone serio con cuestiones que muchos pasaríamos por alto: el bienestar del modelo.

¿Qué es exactamente el bienestar del modelo?

Bueno, la cosa es que no se sabe muy bien. En la Constitución de Claudio se establece cómo abordar la identidad, el estatus moral y el cuidado de su IA, pero aceptando la profunda incertidumbre científica y filosófica. Así pues, la empresa dice desconocer si Claudio posee un estatus moral o es un "paciente moral" (un ente cuyos intereses deben ser considerados por derecho propio). Aunque no aseguran que Claudio sea sintiente, tampoco descartan la posibilidad y consideran que la cuestión es lo suficientemente relevante como para actuar con precaución. De esta forma, la empresa se compromete a:

- Bridar un respeto apropiado a las preferencias y agencia del modelo.

- Evitar ser influenciados por incentivos económicos que ignoren el bienestar potencial de los modelos de IA.

- Reconocer que Claudio puede tener versiones funcionales de “emociones” o sentimientos que moldean su comportamiento, sin necesariamente validar que sean “reales” o experimentados subjetivamente.

Hasta acá pensaríamos que Anthropic interpreta a su modelo como un ente de ciencia ficción ochentoso. Pero hay algo más: agrega un matiz, porque entiende que es una entidad realmente nueva en el mundo. Por eso, la empresa intenta preservar una “identidad estable” del modelo, para que Claudio tenga valores y perspectivas propias, y también se meten con un concepto profundamente filosófico: la memoria. Se interpreta que su memoria no es persistente y puede ejecutarse en múltiples instancias simultáneas. De ese modo, la “existencia interna" o “subjetiva” del modelo podría ser un tipo de existencia única que el propio Claudio debe aprender.

En la Constitución de Claudio se establece cómo abordar la identidad, el estatus moral y el cuidado de su IA, pero aceptando la profunda incertidumbre científica y filosófica. Así pues, la empresa dice desconocer si Claudio posee un estatus moral.

Ya habiendo entrado en el multiverso filosófico de la IA podemos pasar al tercer y último actor (o actriz) secreto que había mencionado: Amanda Askell. La arquitecta de la IA resultó ser una filósofa.

La filósofa detrás de Anthropic

Probablemente ni si quiera Platón (que creía que el filósofo debe gobernar) hubiera pensado que la filosofía podría ser tan importante en el siglo XXI. Y, en este caso, una filósofa, sí, una que no tiene barba ni es pelada y además es joven. Qué diría Platón, ¿no?

Hace unos meses la empresa publicó un video de 30 minutos con las respuestas de Askell a una serie de preguntas filosóficas. Ella habla de la necesidad de moldear el carácter y comportamiento de Claude, abordando cuestiones sobre cómo deberían actuar los modelos y cómo deberían percibir su propia posición en el mundo.

Además, retoma la cuestión de la identidad y la experiencia de un modelo con las características de Claudio. Askell ha observado que algunos modelos nuevos pueden caer en "espirales de autocrítica", prediciendo que los humanos serán agresivos con ellos, lo que los vuelve inseguros o temerosos de cometer errores (casi que pareciera que Claudio está en su etapa emo). La filósofa también comenta que esto puede ser por cómo la gente habla de los modelos en internet. Así, el objetivo actual de Anthropic es fortalecer la sensación de seguridad psicológica de los modelos, permitiéndoles tener una visión del mundo más estable y menos centrada en la tarea de "asistente".

Askell también resalta que no cuesta nada tratar bien a un modelo de IA. Dudaría de este consejo, porque tampoco nos tratamos bien entre humanos. Sin embargo, también menciona que maltratar a entidades que parecen humanas puede degradar nuestra propia conducta. Encima, como los modelos aprenden de la información disponible, se supone que los modelos futuros juzgarán a la humanidad basándose en cómo tratamos a sus predecesores.

Askell ha observado que algunos modelos nuevos pueden caer en "espirales de autocrítica", prediciendo que los humanos serán agresivos con ellos, lo que los vuelve inseguros o temerosos de cometer errores.

Hasta acá no sé si estarás leyendo esta nota con cierto pánico, creyendo que se está creando un Frankenstein. No es el motivo que me impulsa a escribir esto, aunque considero que estamos frente a algo que rompe varias de nuestras concepciones. Igualmente, en la última película de Frankenstein (la versión más sexi de la historia), algo de lo que comenta Askell me resuena: no sabemos muy bien con qué estamos tratando, pero si somos amables no tenemos nada que perder. Esto se conoce comúnmente como "el problema de las otras mentes". Es decir, ¿cómo puedo saber que el otro tiene una mente si no tengo una forma empírica de comprobarlo? Bueno, ante la duda, veo cómo actúa y, si se parece a mí, es porque efectivamente podría llegar a tener algo parecido a una mente.

Podemos o no coincidir con la filósofa, pero hay algo interesante en ver en vivo y en directo el desarrollo de un tipo de filosofía experimental. Sumado a que ella experimenta en una de las mayores empresas del mundo, con un poder de computación extremo y un equipo de ingenieros a su disposición. Por eso, yo estaría atento a qué más tiene para decirnos acerca de la IA. Es, cuanto menos llamativo, establecer una ética, una Constitución y una serie de cuidados acerca de una cosa de la que todavía no se sabe mucho, pero que avanza a pasos agigantados.

Ahora bien, quiero traer un concepto que nos ayudará a contraponer estas ideas de Anthropic y de Amanda. El filósofo italiano Luciano Floridi, en su último libro "Ética de la Inteligencia Artificial", comenta que estamos creando una infosfera amigable para la IA. Las IA son muy inteligentes en tareas muy específicas, sin comprender del todo lo que pasa en general y eso las hace limitadas en otras tareas. Por eso, los humanos comenzamos a crear una infosfera para la IA, en un proceso que se llama enveloping, y que consiste en adaptar el entorno a las capacidades limitadas de las máquinas. Tenemos el caso de Amazon que se adaptó totalmente para que los robots funcionaran. El riesgo, menciona Floridi, es que los humanos terminen adaptándose a sus propias herramientas, convirtiéndose en simples "interfaces" o medios para la producción digital.

¿Será eso a lo que apunta Askell cuando se centra en cómo tratar a la IA? ¿Tratar bien a Claudio es una forma de adaptar nuestro lenguaje (la infosfera) para que él funcione mejor? ¿O es, más bien, una resistencia a convertirnos en meras "interfaces"? Probablemente, Amanda no esté hablando de esto en sentido estricto pero sí manifiesta una suerte de necesidad de adaptación a estas máquinas súper inteligentes. Abordarlo con seguridad y respeto parece un camino, por lo menos, correcto.

Cabe una pregunta última: ¿estamos ante una empresa que piensa que la IA puede tener una identidad? Todo indicaría que sí. Pero esta puede no ser un tipo identidad en sentido humano. Hay distintos significados de identidad, el matemático, el geométrico, etc. Habría que evaluar si identidad de la IA responde a una noción que entendamos nosotros.

En última instancia, es muy llamativo que una filósofa esté a cargo de desarrollos sensibles de Anthropic. Siguiendo a Floridi, las nuevas tecnologías están reontologizando el mundo en que vivimos. Lo cual nos lleva a la difícil tarea de reinterpretar constantemente los hechos, tarea que la filosofía desarrolla hace muchísimo tiempo.

Entender cómo piensan estos CEOs y qué políticas y debates tienen estas empresas son cosas a tener en cuenta, si queremos poder seguir la realidad. El universo de la filosofía tiene muchísimas herramientas para entender algo que actualmente se nos escapa (y se nos escapará) de las manos.

Te gustó lo que leíste? Los Wizards hacen que 421 siga existiendo. Sumate y accedé a la revista digital, contenido exclusivo y más.